Das muss gehen. Wenn nicht dann ist vielleicht irgendwas bzgl. VRR (Variable Refresh Rate) Fehlerhaft?

Browser? Hardwarebeschleunigung? Windows Game Mode?

Das hab ich falsch verstanden, da muss ich bei Zeiten nochmal schauen wie sich meine Karte verhält.

Auch die Sprünge im Idle sprechen dafür, dass mit oder nach dem Spiel irgendwas in Bezug auf VRR nicht funktioniert.

DDU hattest du nach der 6800XT mal laufen lassen? Bios aktuell etc.?

Hab erst das AMD Cleanup Utility genutzt. Gestern dann mal DDU. Brachte leider keinen Unterschied. Bios ist irgendwann im Oktober aktualisiert worden. Hardwarebeschleunigung habe ich sowohl unter Windows als auch im Browser ausgeschaltet. Sobald das nämlich aktiv ist, ruckelt jedes Video, sobald man etwas vorspult. Aber auch nur bei der 7900XT, mit der 6800 gibt es diese Probleme nicht. Ich hatte zwischendurch auch mal den zweiten Monitor komplett abgeklemmt, FreeSync ausgeschaltet, aber auch das brachte keine Besserung.

Also 4K YT läuft bei mir mit 57Watt im Edge und 52Watt im Firefox.

Und wenn die Karte meint, sie muss kurz auf 3GHz springen, soll sie es Halt machen.

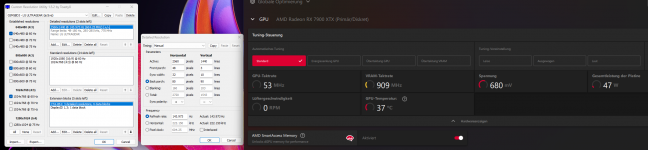

Konnte ich aber noch nicht beobachten, ab und zu auf 1420MHz bei gleichem verbrauch.

An sich ist mir das auch egal, solang alles stabil läuft. Aber mir ergibt sich dann der Sinn nicht, warum man den Takt einstellen kann, wenn die Karte eh macht, was sie will. Zusätzlich steigt der Verbrauch auf über 100W. Da kann jeder sagen, was er will, aber das ist definitiv nicht normal.

Das ist ja auch alles, im Endeffekt nichts Neues. Google ist voll damit und auch nachdem der Treiber das Idle Problem gefixt haben soll. Und dass man ewig experimentieren muss, bis alles anständig läuft, ist auch nicht normal.

Also nochmal zusammengefasst die Probleme die ich mit der Karte hatte:

- Hoher Verbrauch bei simplen Videos sobald man auf Vollbild schaltet (100-120W)

- Nachdem man ein Spiel beendet, taktet die Karte nicht richtig runter. Gpu Takt schwankt zwischen 0-3000+ Mhz obwohl 2400 als Max Takt angegeben ist. Vram immer auf Anschlag.

- Zero Fan ist immer an. Deaktivieren bringt nichts (kleinstes Problem und fast egal)

- Sound Crackling sobald HW Beschleunigung aktiv ist. (USB Soundkarte)

- Und die extrem schlechte Effizienz im Teillast Bereich. (Wusste ich aber vorher, nur das es so schlecht ist, war mir nicht bewusst.

Was genau die Probleme verursacht hat, weiß ich nicht. Ob es die Karte ist oder eine Kombination aus Hard und Software. Testweise habe ich mal meine alte GTX 1080 eingebaut, mit der läuft alles wie mit der RX6800 ohne eines der oben genannten Probleme.