Jedes einzelne Argument ist nur so gut wie die gesamte Kette.

Jo weil viele es auch einfach nicht wissen wird gerne schon bei ~20W Unterschied alle Argumente Richtung der CPU oder GPU geschoben, die den niedrigeren Verbrauch auswirft.

Völlig überzogen.

Genau das meine ich auch. Mir ging es um die Verhältnismäßigkeit Mehrverbrauch zu Mehrpreis.

Manche setzen ja 40 Watt Mehrverbrauch mit 40€ gleich...

20, oder 40W können relevant sein, oder werden. Je nach Nutzung.

20-40W im idle, bzw bei geringer Last, die aber Beispielsweise 90% der Zeit ausmachen sind sehr wohl relevant.

Also man muss für sich schauen. Ich habe vor ein paar Wochen mal eine Beispielrechnung in Thread XY gemacht und dabei kam für mein Nutzungsszenario tatsächlich raus, auf eine Nutzungsdauer, die viele hier als normal ansehen, kostet mich die AMD Variante 160€ mehr an Strom, als die Nvidia Variante.

Wobei sich das jetzt geändert hat, da mein Spielerechner nicht mehr mein Homeoffice supporten muss, dafür steht da jetzt ein 25W client...

Das bedeutet, das es jetzt wohl nur noch 40€ auf die Nutzungszeit sind, wenn überhaupt. (Gerade nachgerechnet, etwa 33-42€, bei etwa 5-6 std/Woche Gaming )

Gehen wir mal von großzügigen 40 Watt Mehrverbrauch aus:

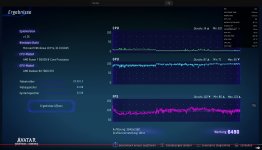

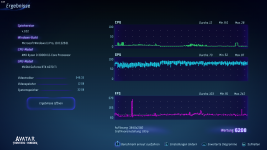

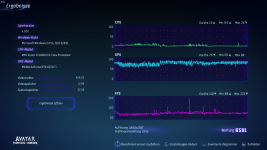

Anhang anzeigen 1449963

Bei einem aktuellen Strompreis von durchschnittlich 30cent (Neukunden zahlen aktuell im Schnitt 27 cent) entsprechen 100€ ca. 333 KWh.

Das sind bei 40 Watt ca. 8325 Stunden Gaming.

Davon kannst du im Jahr 7 Tage die Woche 22 Stunden zocken.

Oder 2 Jahre lang jeden Tag 11 Stunden..

Oder 3 Jahre lang jeden Tag 7 Stunden..

Oder 4 Jahre lange jeden Tag 5 Stunden...

JEDEN Tag.

Also ich weiß ja nicht was ihr den ganzen Tag so macht, aber ich schaff das nicht..

Naja, ich bin auch zu alt für so nen Quatsch.

Vor allem für so nen Quatsch wie Fanboy-"Gelaber"..

ich schiele übrigens auf ne 4080 Super und hab ne 6800XT..

In diesem Sinne

Jetzt nimm aber auch die aktuellen, modernen Spiele.

Dann bist du eher bei XTX gegen 4070ti(S) und schon hast du eher 355 zu 270W.

Oder Custom, gegen Custom, da werden das schnell 400 zu 275W.

Schon kann man das erreichen.

ABER das ist alles höchst individuell und das sollte, oder muss jeder der auf den Verbrauch schauen möchte für sich einmal beleuchten. Was mache ich mit der Maschine, wie oft usw.

Dann kann man so etwas mit rein ziehen. Muss aber auch nicht.

Naja, für bissl RT hier und da reichts ja. Man weiss vorher schon, worauf man sich einlässt. Mit den 12 GB weiss man halt nie, ob es auch für den nächsten " Blockbuster" reicht - und ich betone nochmal, dass sollte es bei dieser Preisklasse nicht geben. Das würde ich AMD genauso ankreiden, wenn sie dasselbe Spielchen spielen würden.

Macht AMD doch, mit der RT LEistung.

Du weißt nie, ob der nächste Blockbuster nicht mehr RT verwendet und wie Avatar nicht separat regelbar macht.

Es spielt kaum eine Rolle, man tauscht nur das eine Übel, gegen ein anderes.

Preis/Leistung war noch nie die Domäne der 4070Ti und mit der TiS ändert sich das auch nicht. Es ist halt dieses 12GB Thema vom Tisch und man hat messbar mehr Leistung, aber beim Spielen wird es gefühlt immer noch die gleiche Leistung sein und daher scheint die Begeisterung für die Karte geringer auszufallen und die Argumente für die Karte gehen viel mehr in Details unter speziellen Spezialbedingungen.

Warum nicht objektiv. Tests haben allesamt etwas anderes bescheinigt.

Die 4070S hat die Preis/Leistung verbessert, wenn auch nur um 10%, der große Sprung war das auch nicht, aber doch ein Sprung der besser wahrgenommen wurde.

Stromrechnung ist imo das neueste Scheinargument auf dem auch von den Herstellern wahnsinnig herumgeritten wird und das gefühlt oft nur nachgeplappert wird. Wenn wir das Spiel spielen wollen, dann bitte. Ich stell den Framelimiter in jedem Spiel auf 60fps. Das spart Leistung und schont die Umwelt. Ich und meine vielen Freunde lassen schon so viele GPUs nur noch auf halber Leistung fahren, dass Frankreich ein AKW abschalten musste. Werdet Mitglied meiner Kampagne und schreibt auch in Eure Forensignatur "60 Hertz für die Umwelt, Stoppt den Strom!"

So so, ein Scheinargument... War es das zu RX6000 Zeiten auch, als AMD User im Forum auf der höheren Effizienz beim reinen Rastern rum geritten sind?

) lassen und dann mit "Mehrverbrauch" argumentieren... Ich weiß nicht.. Da bin ich raus..

) lassen und dann mit "Mehrverbrauch" argumentieren... Ich weiß nicht.. Da bin ich raus..