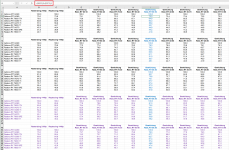

Ich finde es sehr spannend, dass die 4070Ti in 4K auf die 7900XT aufholt.

Nur 10%, obwohl es in WQHD noch 14% sind. Oha.

Schmalspur-Bandbreite schlägt Infinity Cache?

Habe ich so noch nicht gesehen.

Ich denke nur das gerade das letzte drittel diesen Jahres deutlich zeigt, das der RT Zug fahrt aufnimmt. Auch rund um die UE5, oder auch jetzt die Snowdrop Engine, oder andere größere Engines die öfter eingesetzt werden dürften sprechen eine deutliche Sprache.

Klar wird auf den Konsolen nur das Minimum an RT eingesetzt, aber auch jetzige Titel zeigen das dennoch auf dem PC ganz anders RT eingesetzt werden kann.

Wenn dann von den großen Vorteilen bei AMD gesprochen wird, bezüglich Langlebigkeit, oder Zukunftssicherheit muss ich schmunzeln. Weil ich sehe keinen Vorteil durch den großen VRam, wenn ich sowieso schon Details reduzieren muss. So wird nur um- verlagert.

Es ist nur die Frage, wo sind die Zugeständnisse größer, oder häufiger.

Weiter geht es mir auch nicht verbissen, darum AMD Hardware madiger zu machen. Es ist nur lediglich nicht objektiv, heute eine 4070ti als weniger Empfehlenswert zu beschreiben, als eine 7900XT.

Dazu bleibt noch anzumerken, worüber reden wir eigentlich. Das eine solche Karte auch in zwei, drei, vier Jahren noch schöne Spiele darstellen wird, ist außer Frage, sofern ein Einstellungsmix zum Einsatz kommt.

Es wird so glaube ich langsam Zeit diese Trennung in RT und non RT Index aufzuheben.

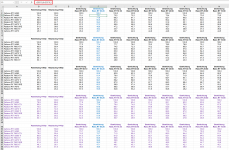

Denn wenn man einmal genauer schaut, bekommt man bei der RTX 4070 -6% Rasterleistung aber +33% RT Leistung vs 7800XT und zusätzlich noch DLSS, wo Performance oder Balanced bereits das Niveau von FSR Quality bieten.

Das ist auch etwas, das für mich etwas zu kurz kommt.

Was unterm Strich bedeutet, dass Nvidia sowohl in RT als auch in Raster spielend AMD Leistung erzielt.

Entweder drückt sich PCGH absichtlich um dieses Faktum, weil sie sonst die AMD Fans hier verärgern, oder sie sind zu wenig neutral, was ich etwas schade fände.

Das geht mir zu weit

. Ich denke das man da eher an dem Punkt ist, das niemand wirklich 100% objektiv ist. Jeder einzelne Mensch wertet gleiches, immer unterschiedlich.

Der Speicher ist sicher nachteilig, allerdings lässt sich das schnell beheben, meist schon durch ein späteres build.

Fehlende Leistung aber nie. Deshalb würde ich sogar lieber mit einer 3080 mit verkrüppelten 10GB als mit einer 6800XT 16GB spielen, wenn ich dadurch in den Genuss von DLSS und RT komme.

Ob ich jetzt Details reduzieren muss, weil der Speicher knapp wird, oder weil die Leistung nicht ausreicht, halte ich für Latte und würde nie eines von beidem höher bewerten.

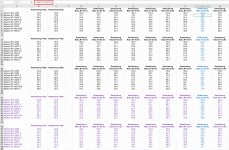

Mit dem neusten Build haben wir am Testrechner heute selbst in 4K mit DLSS Qualität auf einer 4070 Ti keine Nachladeruckler oder schlechte Frametimes mit CapFrameX bemerkt.

Man kommt in dem Spiel mit einer 4070Ti besser zurecht als mit der 7900XT.

Wer ist wir? Sorry, wenn ich zu offensichtliches nicht sehe.

Zu den Zeiten als die BQ noch genauer angeschaut wurde, wäre ne Radeon mit FSR heute auch in Rasterizing schlicht unterlegen, weil man einfach mindestens DLSS Balanced mit FSR Qualität vergleichen würde.

Genauso wie bei Radeons HQ-AF aktiviert wurde und dann reichte es immer noch nicht ganz.

Heute ist man da aber zu lasch und so spielen AMD User immer noch mit viel weniger BQ als nötig.

Dem stimme ich zu. Ich zum Beispiel spiele überwiegen Simulation, Aufbau, Strategie... da spielt RT fast gar keine Rolle, daher habe ich lieber die 7800XT genommen als die (dazu noch) teurere 4070 mit weniger Speicher.

Genau, du sagst es selbst.

"Ich zum Beispiel spiele überwiegen Simulation, Aufbau, Strategie..."

Individuell. Ich spiele wenn, dann oft Triple AAA zum Beispiel und damit oft mit RT.

In den Simulationen die ich spiele, sind 12GB übrigens noch kein Problem.