Himmel, gleich zwei, die mit der deutschen Sprache Probleme haben?

Du scheinst die Grundlage meiner Aussage schon nicht zu verstehen [...]

deady1000 fragte nach einer Idikation bzgl. relevanter Probleme/Nachteile bzgl. PCIe 3 und ich gab ihm etwas Material als Entscheidungshilfe und der vorgreifenden Aussage, dass der Impact gering ist, genaugenommen sogar sehr gering. Dann kamst du mit deiner verkomplizierenden Aussage (die ihn möglicherweise eher weniger interessierte) und dann habe ich dir dargelegt, dass der Impact faktisch tatsächlich sehr gering ist und zur besseren Illustration habe ich dabei sogar auf den Unterschied PCIe 2.0 gegen 4.0 zurückgegriffen (inkl. aktueller Titel in MaxSettings) und selbst bei diesem "extremen" Bandbreitenunterschied zeigen sich nur verhältnismäßig kleine Änderungen in den Fps, sowohl in FullHD bei hohen Fps als auch in 4K bei deutlich geringeren Fps. Und jetzt versuche du mir noch mal zu erklären was ich angeblich nicht verstanden hätte. Mir scheint eher, du willst nicht akzeptieren, dass PCIe 4.0 hier nur eine untergeordnete Rolle spielt oder geht es hier nur darum das letzte Wort zu haben?

Keiner hat in Abrede gestellt, dass bzgl. der Draw-Calls über den PCIe-Bus die Bandbreite eine Rolle spielt, aber halt nur eine geringe, wie man ja recht eindeutig an diesen (und auch vielen anderen) Daten sieht und dann kommt wiederum alles zurück aufs Lesen:

a) "

Nein, unbedingt benötigen wird man es [PCIe 4] zweifelsfrei nicht."

b) "

NEIN. Ampere auf PCIe 3.0 x16 wird zweifelsfrei nicht zu katastrophalen Fps-Einbrüchen führen"

c) "

an der grundlegenden Situation ändert sich nichts bzgl. der vermeintlichen Wichtigkeit von PCIe 4.0"

Was hast du nun an den drei Aussagen nicht verstanden? Wir sagen beide, dass es ein wenig Fps kostet. Du selbst schreibst abschließend "

Du verlierst auf jeden Fall etwas Performance" und verwendet hier ebenfalls ein sehr unbestimmtes "

etwas" und dennoch versuchst du hier ein Fass aufzumachen, noch dazu, wo selbst in obigem Extrembeispiel mit über 200 Fps gerade man 6 % Fps verloren gehen.

Ob für deady1000 nun möglche Fps-Einbußen im Bereich von 2 % bis schlechtestenfalls 5 % (man beachte, dass obige Tests PCIe 2.0 verwendeten) relevant und schwerwiegend genug sind um auch noch eine neue Plattform anzuschaffen, muss er selbst entscheiden. Aber selbst wenn er als absoluter Enthusiast, der dem letzten Frame hinterher jagt, diese Frage mit Ja beantwortet, ändert das dennoch nichts daran, dass der Einfluss von PCIe auf die Fps nur sehr gering ist.

Mit Ampere können tendenziell noch ein paar Draw-Calls mehr abgesetzt werden, aber auch hier wird der relative, zusätzliche Verlust mit Blick auf PCIe überschaubar bleiben, wenn man bei v3.0 bleibt. Zumal vermutlich der größere Teil der Anwender die Rechenleistung auch primär für eine höhere Auflösung und schönere Grafik (höhere Settings) nutzen wird und eher weniger um seine Fps-Zahl ins Übernatürliche zu steigern, d. h. hier wird die zusätzliche Rechenleistung für komplexere Berechnungen auf der GPU eingesetzt und weniger um noch mehr Fps zu erreichen (und damit deutlich mehr Draw-Calls abzusetzen) und wie auch oben schon bei den über 200 Fps von Wolfenstein zu sehen war, ist das aber auch da kein allzu großes Problem.

Und darüber hinaus als Anmerkung, kann man an den Titeln auch möglicherweise noch die Vorteile von DX12 ggü. DX11 sehen kann, denn der BF5-Test lief mit DX11, während Hitman 2 DX12 verwendete, dass den Draw-Call Overhead zu reduzieren hilft, was möglicherweise auch die kleineren Fps-Verluste aufgrund der geringeren PCIe-Bandbreite bei der Verwendung von PCIe 2.0 erklärt.

Man beachte dennoch das "

möglicherweise", da man den Anteil der Engine und die Verwendung der Engine in dem konkreten Titel ohne Detailkenntnisse nicht abschätzen kann, jedoch ist allgemein bekannt, dass mit DX12 weitaus mehr Draw Calls abgesetzt werden können, was dann natürlicherweise auch deutlich besser über einen schmalbandigeren PCIe-Bus performed.

Anhand der Flops lässt sich die Leistungsfähigkeit in FPS nicht abschätzen. Nicht mal ansatzweise.

Eine Fury X fährt 8.6TFlops auf, die 5700 7.9TFlops. Trotzdem ist die 5700 im Schnitt laut PCGH knapp 60% schneller wie die Fury X.

Eine R9 270X/HD7870 bringt etwas weniger wie 2.6TFlops auf die Waage, eine HD5870 etwas mehr als 2.7TFlops. Trotzdem ist die 270X/HD7870 laut CB knapp 20% leistungsfähiger in ihrem Aufgabengebiet.

Und nun zum zweiten Spezialisten mit potentieller Leseschwäche. Was ist an dem Satz "

Wenn du darauf hinweisen möchtest, dass TFlops nicht direkt auf Fps übertragbar sind, hast du recht" nicht zu verstehen und ebenso an dem ganz grob skizziersten Zusammenhang "

jedoch geben diese [TFlops] i. d. R. dennoch eine halbwegs verlässliche Indikation in welche Richtung man sich [hier bzgl Fps] bewegt."

Insbesondere dann auch noch mit der sehr bewusst großzügig gefassten Aussage "

Dass eine 10 TFlops-Karte in der Renderleistung an eine 20 TFlops-Karte heranreicht, kann man nach aktuellem Stand eher ausschließen".

Du dagegen tust so, als hätte ich eine Formel a la "TFlops * 9,76 = Fps in FullHD bei MaxSettings" aufgestellt.

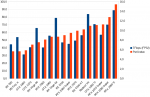

Eingie Anmerkungen zum Graphen:

a) Hier werden TFlops mit Fps-Werten (normalisiert) in Relation gesetzt mittels des PCGH-Index (Die Titan RTX hat hier den Performance-Wert 100 %)

b) Der Index enthält 20 Spiele, es gibt jedoch Titel die AMD oder nVidia benachteiligen. Ich gehe hier in Ermangelung besserer Daten davon aus, dass sich diese Effekte gegenseitig aufheben (was zweifelsfrei leicht optimistisch ist, da man annehmen kann, dass der Markt eher auf nVidia hin optimieren wird).

c) Der Index inkludiert 4 Auflösungen. Das klingt erst mal gut, ist aber ggf. suboptimal, da manch schwachbrüsntigere Karten insbesondere bei 4K Probleme haben werden und deren Ergebnisse dort

könnten sie dort überproportional im Index runterziehen. Da man die Daten jedoch nicht weiter filtern kann, muss ich mich mit dem begnügen, was ich dort frei Haus geliefert bekomme.

d) Bei Navi 10 habe ich die TFlops angepasst, da AMD hier dazu übergegangen ist drei Takt-Bereiche anzugeben (Base, Game, Boost), deren offizielle TFlops-Angaben beziehen sich jetzt jedoch auf den Boost-Takt, der bei nVidia eher dem allgmein nicht angegebenen Peak-Takt entsprechen würde. nVidia's TFlops-Angaben beziehen sich dagegen nur auf den offiziell angegeben Boost-Takt und niemals auf den Peak-Takt, den eine Karte kurzfristig erreichen kann. (Bspw. die RTX 2080 Ti FE mit 1,64 GHz wird offiziell mit 14,2 TFlops angegeben. Nimmt man jedoch den Peak-Takt, der je nach Modell bei über 1,9 GHz liegt, erreicht man hier theoretisch über 16,5 TFlops auf der Karte.)

Was man in dem Graphen nun sieht, ist ein recht grober aber erkennbarer Zusammenhang zwischen TFlops und der Kartenrenderleistung gegeben.

Auffällig sind die überproportinal hohen TFlops-Werte bei Vega, was auf eine etwas unausgeglichene Architektur hindeutet. In Spezialfällen mag das von Vorteil sein, im Rendering nützte das den Vega-Karten jedoch eher weniger. Den Ausreißer (die "GCN-Altlast") hat AMD bei Navi 10 offensichtlich korrigiert und mit Blick auf RDNA2 (in Anlehnung an die von den Konsolen bereits bekannten Daten) wird sich auch die neue Architektur nun voraussichtlich ähnlich zu Navi 10 und Turing verhalten.

Ergo trifft meine Aussage bzgl. einer "Indikation" und "groben Richtung" bzgl. einer Leistungsabschätzung zu und, oh Wunder, es findet sich keine Karte im Graphen, die einen nur halb so hohen Tflops-Wert wie eine andere aber dennoch eine grob vergleichbare Renderleistung hat. Und schlussendlich sollte das auch nicht überraschen in dieser ungenauen Betrachtungsweise, denn die TFlops-Werte stehen bei aktuellen GPU-Generationen in einem festen Verhältnis zu den Shader Prozessoren und deren Leistung zum betriebenen Takt, sodass es hier zwangsweise eine Korrelation geben muss.

Und um noch einmal die Spikes bei den GCN-Karten final zu beleuchten. Es ist hier keinesfalls so, dass die FP32-Leistung überproportional hoch ist bei diesen Karten. Im Gegenteil, der FP32-Durchsatz ist hier pro Funktionseinheit und Takt ebenso hoch wie bei den RDNA-Karten und auch wie bei nVidia. Der FP32-Durchsatz ist hier überall gleich. Das Problem bei den GCN-Karten ist, dass deren Renderleistung dazu relativ gesehen schlicht schlechter ist (i. V. z. RDNA und Pascal/Turing).

Mit RDNA hat AMD dieses Missverhältnis korrigieirt und jetzt sieht das Verhältnis eher so wie typischerweise beobachtet werden kann aus.

Darüber hinaus als abschließende Bemerkung: Ein derartiges Missverhältnis bei RDNA2 wäre zudem fatal, denn die Richtung "viel weniger TFlops aber deutlich höhere Renderleistung ist abwegig". Dagegen die beobachtete Richtung "viel mehr TFlops und deutlich weniger Renderleistung" hätte bedeutet, dass RDNA2 selbst in der größten Ausbaustufe nur mit einer 3060 oder 3070 konkurrieren könnte. Zum Glück hat AMD die Architektur schon mit RDNA umgestellt, sodass man hier nun wieder etwas "geradliniger" mittels der (in diesem Falle behelfsmäßig herangezogenen) TFlops abschätzen kann.

.gif)