grumpy-old-man

Software-Overclocker(in)

Entschuldigt, aber könnt ihr mal bitte das divenhafte Rumhezicke unterlassen, oder das per PN klären? Es nervt allmählich….

Das muss nicht zwingend gegeben sein. Du kannst mit Daten vieles entschlacken, vereinfachen und vorher effizient Aufbereiten. All das kann das NN massiv entlasten was wiederum in einfachere Strukturen resultiert.Ach und die vorhandenen (alten) Bildinformationen während des Renderings verarbeiten und vergleichen kostet keine Performance? Die Komplexität ist eher hoch gegangen, alleine schon weil man einen allgemeinen Algorithmus und keinen per-Game Algorithmus nutzt. Sieht man auch an der nvngx_dlss.dll, die wird mit jeder Iteration größer.

Und zum dritten mal ich sage nicht das es ähnlich gut läuft und du sollst aufhören solche Sachen in den Mund zu legen. Deutliche Performance != Ähnlich schnell wie mit TC. Das die Tensor Cores schneller sind habe ich nie bestritten.Deine Aussage war dass man auch ohne Tensor Cores einen "deutlichen" Performance Gain hinbekommt. Zum dritten Mal Dein Zitat:

Hast recht ist in richtigem Kindergarten ausgeartet.Entschuldigt, aber könnt ihr mal bitte das divenhafte Rumhezicke unterlassen, oder das per PN klären? Es nervt allmählich….

DP4A ist keine dedizierte HW-Einheit, sondern schlicht zusätzliche "Verdrahtung" in den regulären Shader-Einheiten, um diese Operationen effizienter berechnen zu können und im Idealfall wird die Funktionalität mittels einer einzigen Instruktion angeboten.Was meinst du mit Shader-Emulation? DP4 ist ja kein Shader Kram. Das sind dedizierte Vektoreinheiten. XeSS auf normalen Shadern wird wohl nicht so der Hit denke ich mal.

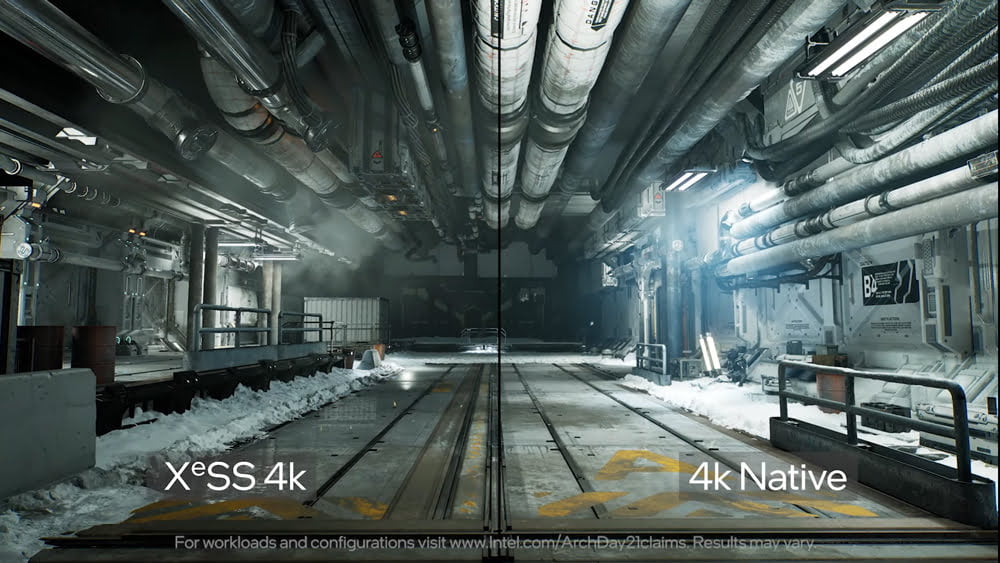

Neben Hardware für Raytracing spendiert Intel den Arc-GPUs auch spezielle KI-Beschleuniger. Die „Xe Matrix eXtensions“ (XMX) in den Xe-Kernen sollen Intels DLSS-Alternative XeSS antreiben.

) gegen hundert Pistolen (AMD, eventuell auch wieder intel

) gegen hundert Pistolen (AMD, eventuell auch wieder intel  ). Klar, schlägt die Kanonenkugel ein, dann kracht es. Aber bis die Kanone einsatzbereit, durchgeladen ist, können schon hunderte Pistolenkugeln eingeschlagen sein.

). Klar, schlägt die Kanonenkugel ein, dann kracht es. Aber bis die Kanone einsatzbereit, durchgeladen ist, können schon hunderte Pistolenkugeln eingeschlagen sein.

...Ich gehe mal davon aus dass Nvidia XeSS zukünftig auch über Tensor Cores pushen wird...

Jup, die Korrektur ist gekauft. Ich würde es aber dennoch als Fixed Function beschreiben. Normale Shader Instruktionen sind das nicht. Das sind Skalarprodukte, die Hardware beschleunigt ausgeführt werden.DP4A ist keine dedizierte HW-Einheit, sondern schlicht zusätzliche "Verdrahtung" in den regulären Shader-Einheiten, um diese Operationen effizienter berechnen zu können und im Idealfall wird die Funktionalität mittels einer einzigen Instruktion angeboten.

Wie gesagt, übermäßig viel beschleunigt wird da nicht. *) Das wird über die regulären Shadereinheiten berechnet. Ich vermute hier tragen die "zusätzlichen Verdrahtungen" lediglich ein paar zusätzliche Datenpfade und für diese Operation fest angebundene Schattenregister bei um die Daten für diese MMA-Operation schneller hin und her zu schieben.Jup, die Korrektur ist gekauft. Ich würde es aber dennoch als Fixed Function beschreiben. Normale Shader Instruktionen sind das nicht. Das sind Skalarprodukte, die Hardware beschleunigt ausgeführt werden.

Natürlich tun sie das, mein Freesync Monitor mit meiner Nvidia GPU unterstützt G-Sync Compatible, und das geht nur weil Nvidia das supportet.Genau das habe ich mir beim Lesen dieses Satzes auch direkt gedacht. Seit wann unterstützt nvidia bitte andere Systeme als die eigenen?

Sie haben doch die Marktmacht und wissen ganz genau dass sie nicht gezwungen werden können.

Du widersprichst Dir, natürlich tun sie das, das gibst Du sogar selber zu.Natürlich tun sie sowas nicht! wie lange hat es gedauert bis Nvidia es dann mal langsam zugelassen hat das Freesync Monitore an den Karten richtig funktionierten? 'In meiner Erinnerung waren das Jahre,

und noch lange kein Garant das sie die nächsten freien Entwicklungen überhaupt mal unterstützen.

Nein eben nicht. Wenn ich mich noch richtig erinnere ging es in dem von mir zitierten Beitrag um die Frage warum sich damals alle Leute über DLSS geärgert haben und jetzt FSR aber gefeiert wird.Man hat aber auch für dafür mehr bekommen.

Nehmen wir mal die RX 5700 XT und die RTX 2070 super. Beide nehmen sich in der Rasterleistung nicht viel.

Während man mit der Nvidia Karte FSR/DLSS/Raytracing bekommt, steht aus der Habenseite von der RX 5700 XT nur FSR.

Was jetzt jemand will/braucht ist eine andere Sache. Aber unbestreitbar ist, daß eine RTX 2070 super mehr zu bieten hat. In Cyberpunk war ich, bei einer Auflösung von 3440x1440p und identischer Einstellung, mit der RTX 2070 super/DLSS Quali schneller unterwegs als mit der RX 6800.

Was DLSS anno 2018 abgeliefert hat interessiert doch nicht. Wir haben 2021 und FSR muß sich mit dem aktuellen DLSS messen.