Joa Nvidia kann das machen weil Rdna 3 so schlecht ist. Die 4070 also eigentliche 4060 hier reicht ziemlich weit nach oben was AMD Karten angeht. Wie peinlich wäre das denn wenn die Tatsählcih die 4060 wäre und Nvidia all in gegangen wäre mit der 4090? Also quasi PAscal 2.0 Todesstoß. Denn das hätte ADA mit 2 vollen sprüngen locker werden können. Aber selbst kastrioert bis zum eght nicht mehr führen sie AMD vor...

Theoretisch gesehen ist das korrekt, aber würde Nvidia "All-In" gehen, müssten auch die Preise mächtig steigen oder Nvidia verliert gut Marge.

AMD's Herstellung ist beim direkten Vergleich deutlich günstiger, nicht nur, dass dank Chiplet die Die's nicht so groß werden müssen (was die Ausbeute verbessert) man kann auch noch 5nm und 6nm Fertigung kombinieren, was deutlich günstiger als Nvidias angepasster N4 ist. Die LowEnd 7600 wird gar komplett in 6nm produziert, die Ausgangslage ist für AMD also entspannter. Nvidia

muss seine RTX4000 also so "kastrieren" damit die Marge weiterhin rosig aussieht. AMD könnte auch noch nen paar CU's auf die XTX draufwerfen, Platz ist da noch und da der GCD ist ja gerade mal 306 mm² groß, theoretische +50% Cu's wären da locker möglich und in der Herstellung machbar, außerdem könnte man auch noch mal doppelt so viel L3-Cache spendieren mit dem bekannten 3D-stacking von den CPU's.

Technisch könnte AMD die ~20% zur 4090 locker aufholen, aber so ein Produkt wäre einfach nicht konkurrenzfähig, da es locker 50%-100% teurer als ne XTX in der Herstellung wäre. Wie AMD selber in nem Interview mal gesagt hat, der Markt ist noch nicht bereit für High-End Karten von AMD, eine Karte die teurer als ne 4090 wäre muss diese schon deutlich überholen, damit sie Käufer findet. Also spart AMD sich den Ärger und produziert lieber kostenorientiert und mit mehr Marge.

Nimm eine 3060 und die rx 7600 verbauchen ziemlich gleich viel nur das ampere auf einem relativ schlechten samsung prtozess läuft und AMD aber tsmc nutzt. Trotzdem ist nvidia was ingenierkunst angeht meilenweit voraus. Aslo warum sollte man die 7600 kaufen? wenn die 3060 um welten besser ist und imo auch die 4060 rein wegen der software.

Die 3060 ist erst interessant, seit sie im Preis deutlich unter 300€ gefallen ist, vorher lag auch die wie Blei in den Regalen. So etwas wie Ingenieurskunst ist kein Kaufgrund, die Karten verbrauchen das gleiche, das Warum kann mir als Kunde doch völlig egal sein. 4060 und 7600 sind beide zu den aktuellen Preisen absolut nicht zu empfehlen, das liegt aber hauptsächlich an den 8Gb Vram und nicht an irgendwelchen Softwarefeatures, deswegen sind beide Karten ja auch kein Thema in der DIY Szene. Um Welten besser ist auch hart übertrieben, die 3060 verkauft sich "nur" über den Vram, performancetechnisch ist sie einer 7600 unterlegen und holt das auch bei RT nicht auf.

Amd ballert sich gerade komplett aus dem DGPU Markt. Wenn die so weitermachen wird intel die locker einholen den Sofwtaretehcnisch ist XESS bereits besser als FSR. Die Leistung der Arc Karten ist manchmal sogar extrem hoch für die erste Generation und RT Technisch auf ampere Niveau. Denke Intel wir in ein paar jahren sich gut mit Nvidia Prüglen und AMD platz einnehmen. aber AMD hatte genug Jahre immer wieder zu enttäuschen. Jahrelange probleme noch immer nicht beseitigt wie den Youtube verbrauch oder idle vram hochtakterei das oft die lüfter naspringen was einfach nervig ist.

Intel ist bei den d-GPU's überhaupt kein Thema und Nvidia musste einen Umsatzrückgang von 38% bei den Gaming-GPU's hinnehmen, trotz extrem hochpreisiger Produkte. Aktuelle Marktschätzungen setzen den bestehenden Trend fort, tendenziell dürfte Nvidia sogar Marktanteile verlieren, da hier massiv in AI investiert/umgeschichtet wird, was bei AMD in dem Ausmaß noch nicht möglich ist.

XeSS ist völlig uninteressant und kein Kaufgrund für Arc, genauso wenig wie FSR2 kein Kaufgrund für AMD wäre, läuft ja eh überall. Wie man bei der aktuellen (quasi abwesenden) Situation von Intel im GPU-Markt denken kann, die wären in ein paar Jahren die Nummer 2 ist mir völlig schleierhaft. Intel muss erst mal beweisen, dass Arc überhaupt bis Celestial geschweige denn Druid bei den d-GPU's überlebt und sich nicht etwa gänzlich in den Mobile-Bereich verabschiedet.

Der Idleverbauch und nicht runtertaktender Vram ist in meinen Augen der größte Nachteil an RDNA2/3, es ist mir wirklich unverständlich, wie das immer noch nicht (vollständig) gefixt sein kann.

nvidia ist teuer aber der scheiss geht wenigstens. würde nichtmal amd nehmen wenn die halb so billig wären. funktion bringt mirr mehr als das wissen beim unstabil sein joa hast geld gespart hat sich das jetzt ausgezahlt? die antwort war jedes mal ein nein.

Bei solchen Aussagen erübrigt sich dann auch jede Diskussion, denn hier geht es nicht um eine objektive Grundlage sondern um Markentreue. Du würdest AMD nicht mal zum halben Preis kaufen? Eine 4080 kostet minimum 1250€ aktuell, würde AMD halb so viel kosten, also eine 7900XT beispielsweise ~625€, dann ist es völlig egal was du willst, du könntest eh keine kaufen, weil sie überall ausverkauft wäre.

Da läuft auch nichts unstabil, keine Ahnung was solche Aussagen immer sollen. Ich verbaue in meinem Freundes- und Familienkreis nahezu ausschließlich AMD und das seit Jahren, weil es abseits des Highends einfach (fast) keinen Sinn ergibt Nvidia für teures Geld zu kaufen. Bösewicht Nummer 1 für Probleme ist schon immer Windows gewesen, (ernsthafte) Probleme mit GPU-Treibern kommen so gut wie nie vor.

Ja das lassen die sich fürstlich bezahlen. Hab auch 650 gezahlt für meine 4070. Absolut krank und Teuer wobei mit inflation und alles drium und dran wären 549 okays gewesen wonbei ist ja eine 60 Karte......

Was war die Option gewesen 300 watt brecher von amd die nix können ausser raster und fsr ist sogar schlechter als igti in Ratchet und CLank laut DF,oder auf die Konkurrenz von der 4070 Warten(also monate) das habe ich dann doch gelassen weil rdna 3 nunmal nicht gut ist. Da wäre ja Rdna 2 refresh auf neuem prozess besser gewesen imo..... DLSS ermöglicht mit mit dlls balanced zu zocken damit läuft alles in 4k und dieht erstaunlich gut aus für das es nur 1280p sind.

650€ für eine 4070 ist schon hart teuer, das merkst du offensichtlich ja selber. Ist ja auch überhaupt nicht schlimm, jeder soll das kaufen worauf er Bock hat. Solange man mit seiner Kaufentscheidung glücklich ist, ist ja alles okay.

Was ich dann jedoch wieder dämlich finde, ist sich seinen Kauf schön zu reden. Die 6950XT wäre ähnlich teuer oder günstiger gewesen, die kann man auf den Verbrauch auch sehr gut optimieren (dank RDNA2 und Undervolting/MPT) und sie ist bei RT den gleichen Teil langsamer, den sie beim Raster gegenüber der 4070 schneller ist. Der zusätzliche Vram ist auch nicht zu unterschlagen, 12Gb wären mir gerade in 4K einfach zu wenig. DLSS Balanced ist dann auch fast schon Pflicht in modernen Titeln und bei aller Überlegenheit von DLSS gegenüber FSR, zaubern tut die Technik auch wieder nicht, Balanced sieht schon merklich schlechter aus als Nativ. Was machst du dann eigentlich bei den Titeln, die kein DLSS anbieten? Oder spielst du die erst gar nicht?

Nicht alles von AMD ist Schrott oder "kann nix" und obwohl die 4070 Nvidias beste Karte aus dem Ada-Lineup ist, ist das keinesfalls ein Nobrainer. Es kommt immer auf den Usecase und persönliche Präferenzen an, die 4070 ist eine gute Option, wenn man weiß was man da macht und sich der offensichtlichen Schwachstelle von 12Gb bewusst ist, genauso wie die 6950XT einen Blick wert ist, gerade jetzt im Abverkauf mit Starfield.

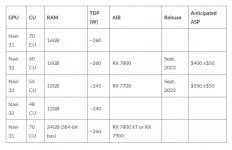

Die 7900GRE ist für unseren Markt uninteressant, das Volumen wird nur einige kleine Chargen groß sein, denn schon in China dürfte das kein volumenstarkes Produkt sein.

Eine 7800 könnte hier ab September schon eher aufräumen, je nachdem ob AMD die für 499$ oder 550$ anbietet. 499$ +Starfield wäre ein gutes Angebot und bei ziemlich genau gleicher (Raster-)Performance zur 4070 aber mit +4Gb Vram recht attraktiv und mMn einer 4070 auch nahezu immer vorzuziehen. Alles eine Frage des Preises, RDNA3 kann da durchaus einiges und ist keinesfalls unbrauchbar.

Leider scheint AMD wie Nvidia aber allen voran auf Marge aus zu sein, man passt sich einfach an dem an was Nvidia vorgibt, mal sehen ob sie ihre Herangehensweise zur Gamescom anpassen.

wie ift ruft wer anweil wieder was net geht mit der amd karte? das geht soweit das händler nur noch nvidia empfehlen weil sie da sich nicht mit sowas rumschlagen müssen. Von mir aus könnte amd komplett verschwinden was gpus angeht. Weder sind sie eine Konkurrenz nich bieten sie irgendwas interessantes. Total langweilig.

wie ift ruft wer anweil wieder was net geht mit der amd karte? das geht soweit das händler nur noch nvidia empfehlen weil sie da sich nicht mit sowas rumschlagen müssen. Von mir aus könnte amd komplett verschwinden was gpus angeht. Weder sind sie eine Konkurrenz nich bieten sie irgendwas interessantes. Total langweilig.