Jetzt ist Ihre Meinung gefragt zu Nvidia RTX A6000: Im Gaming-Test gegen GeForce RTX 3090

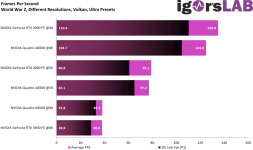

Wie schlägt sich eine professionelle Grafikkarte für wissenschaftliche Berechnungen gegen eine normale Spiele-Grafikkarte im Gaming? Die Webseite igor'sLAB hat den Test gemacht und eine Nvidia RTX A6000 gegen eine Geforce RTX 3090 in 8K, 5K und 4K gegeneinander antreten lassen.

Bitte beachten Sie: Der Kommentarbereich wird gemäß der Forenregeln moderiert. Allgemeine Fragen und Kritik zu Online-Artikeln von PC Games Hardware sind im Feedback-Thread zu veröffentlichen und nicht im Kommentarthread zu einer News. Dort werden sie ohne Nachfragen entfernt.

Zurück zum Artikel: Nvidia RTX A6000: Im Gaming-Test gegen GeForce RTX 3090

Zurück zum Artikel: Nvidia RTX A6000: Im Gaming-Test gegen GeForce RTX 3090

Wie schlägt sich eine professionelle Grafikkarte für wissenschaftliche Berechnungen gegen eine normale Spiele-Grafikkarte im Gaming? Die Webseite igor'sLAB hat den Test gemacht und eine Nvidia RTX A6000 gegen eine Geforce RTX 3090 in 8K, 5K und 4K gegeneinander antreten lassen.

Bitte beachten Sie: Der Kommentarbereich wird gemäß der Forenregeln moderiert. Allgemeine Fragen und Kritik zu Online-Artikeln von PC Games Hardware sind im Feedback-Thread zu veröffentlichen und nicht im Kommentarthread zu einer News. Dort werden sie ohne Nachfragen entfernt.

.gif)

.

.

Angesichts des Preises, des deutlich (!) langsameren Speichers, dem niedrigen Power-Limit und der schlechten/lauten Kühlung ist das ne fette Niederlage. Gut, es bleibt ne Quadro, die für bestimmte Tätigkeiten eventuell benötigt wird, aber ich sehe diesen komischen Vergleich trotzdem nicht ein.

Angesichts des Preises, des deutlich (!) langsameren Speichers, dem niedrigen Power-Limit und der schlechten/lauten Kühlung ist das ne fette Niederlage. Gut, es bleibt ne Quadro, die für bestimmte Tätigkeiten eventuell benötigt wird, aber ich sehe diesen komischen Vergleich trotzdem nicht ein. Das mit dem Kühler ist interessant.

Das mit dem Kühler ist interessant.