Du meinst so was wie Intels Larrabee? Kann man schon, ergibt aber keinen Sinn.Interessant ist das schon.Schade das man keinen Allrounder Entwickeln kann,der CPU und GPU in einem wäre.

Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

News Custom-Chips: Nvidia soll zukünftig auch Spielkonsolen mit "Custom Silicon" bedienen

- Ersteller PCGH-Redaktion

- Erstellt am

G4mest3r

Software-Overclocker(in)

Nvidia wäre sehr gut vorstellbar in Konsolen. Welche CPU dazu ist dann eher die knackige Frage:

AMD oder Intel? Hat ARM überhaupt was passendes, Abwärtskompatibel sollte es besser sein.

"Abwärtskompatibel sollte es besser sein".

Heisst, Du forderst, dass das auf jeden Fall garantiert wird?

Diese News folgte auf dem Fuß. Wegen Abwärtskompatibilität wird hier ein erneutes SoC von Nvidia für Nintendo Swtch 2 vermutet.

Inwieweit alte Spiele durch die neue Hardware ohne Zutun der Entwickler an Qualität gewinnen können, wird in Frage gestellt.

-> Switch 2: Gerüchte über neues Nvidia Custom-Design und Abwärtskompatibilität - Nintendo mauert

Das gilt dann genauso im Umkehrschluss auch für Kunden, die schon auf AMD setzen: weiterhin auf AMD wegen Abwärtskompatibilität?

Hier übrigens noch eine vermeintliche Antwort auf Deine andere Frage - ob Nvidia für die PS6 zu spät dran ist:

-> PlayStation 6 Is Planned to Be the Most Powerful Console of Its Generation; Sony Is Only Considering AMD

Beim Nachfolger zur Xbox Series X für 2028 wird ähnliches vermutet:

-> Microsoft's Next-Gen Xbox for 2028 to Combine AMD Zen 6 and RDNA5 with a Powerful NPU and Cloud Integration

Zuletzt bearbeitet:

Quake2008

BIOS-Overclocker(in)

Raytracing hat Nvidia nicht erfunden, es ist nur eine andere Weise der Berechnung. Im Film wurde sie schon viel früher eingesetzt.NVIDIA ist einfach fantastisch und ein Vorbild für jedes andere Unternehmen und die politischen und religiösen Führer der Menschheit gleichermaßen. Wenn dieses Unternehmen noch glorreicher wäre, würden wir alle vor Bewunderung platzen. Mehr Bewunderung verdient nur AMD, sich mit dem unbesiegbarem Goliath anzulegen, obwohl er niemals eine gute Grafikkarte mit mit DLSS und G-Sync wird erfinden können! Nicht mal Raytracing kann AMD erfinden und die Grafikkarte kommt auch nicht von ATI. Dumm.

Muss aber sagen, da NV Karten echt gut sind.

ja stimmt ja,Filme verwenden ja schon Raytracing.Man merkt es nur nicht mehr,weil man sich ja länger schon dran gewöhnt hat.Bei Filmen tut sich bei der Bildqulität in letzter Zeit nichts mehr.Bei Videospielen kann das auch so passieren wie bei den Filmen ja auch.Ist nur ne Frage der Zeit.

Frank-Langweiler

Software-Overclocker(in)

Aber die Grafikkarte und das Licht im Allgemeinen kommt doch von denen? Davor war alles 16 Bit, ich erinnere mich wieder. Langsam und 32 Bit: Matrox, ATI; schnell und 16 Bit: 3dfx. Beides ab der Riva TNT: nur bei NV.Raytracing hat Nvidia nicht erfunden, es ist nur eine andere Weise der Berechnung. Im Film wurde sie schon viel früher eingesetzt.

Muss aber sagen, da NV Karten echt gut sind.

Tomoyo_Chan

PC-Selbstbauer(in)

Erst seit Covid und selbst da war Gaming noch Nummer 1 bei Nvidia und AMD. 2021/2022 hat das erst fahrt aufgenommen mit den anderen Feldern.Das ist die Gamingsparte doch schon seit Jahren!

Quake2008

BIOS-Overclocker(in)

Wie?? Nvidia hat das Licht erfunden, erzählt das nicht den Falschen.Aber die Grafikkarte und das Licht im Allgemeinen kommt doch von denen? Davor war alles 16 Bit, ich erinnere mich wieder. Langsam und 32 Bit: Matrox, ATI; schnell und 16 Bit: 3dfx. Beides ab der Riva TNT: nur bei NV.

Früher gab es auch eine Option in Spielen die nannte sich "Software Renderer". Der konnte auch alles.

Zuletzt bearbeitet:

Und düstere Schatten kamen von AMD?

Bei AMD halte ich es auch für unwahrscheinlich. Die stehen in harter Konkurrenz zu Nvidia und sowohl wenn man sich Jensens Auftreten als auch den Xeon-Einsatz in früheren Nvidia-Rigs anguckt, dann ist das eine beidseitige Einstellung. Aber Intel war schon mal offen genug, Prozessoren mit AMD-Grafikeinheit zu verkaufen und Gelsinger hat zumindest die Frage "Intel Prozessor mit Nvidia-IGP?" zumindest öffentlich mit "That would be great!" beantwortet. Bei einem Konsolenprojekt hätten sie auch gute Gründe, aufgeschlossen sein – seit der Xbox hat Intel da kein Geld mehr verdient und hinreichend gute Grafikeinheiten können sie vorerst nicht anbieten. (Alchemist kann zwar die nötige Leistung für heutige Generationen erreichen, braucht dafür aber überproportional große Chips. Battlemage müsste da einiges an Rückstand abbauen, um in diesem kostenopimierten Markt bestehen zu können.) Nvidia als Türöffner käme also gerade recht und es ist auch im Interesse Intels, wenn sich Nvidia an x86-CPUs bindet, die sie nicht selber herstellen können. Umgekehrt wäre ein weiteres Erstarken von Grace-basierten Designs ein Rückschlag von Intel. Die haben schon Apple an ARM verloren.

Nvidia müsste seine eigene CPU mit einbauen. Weder Intel noch AMD würden nur die CPU für eine Konsole liefern wollen im Jahr 2024. Intel würde immer eine Core+Arc Lösung verkaufen wollen und AMD immer irgendwas Ryz+RDNA (oder wie auch immer deren Technologien genannt werden)

Bei AMD halte ich es auch für unwahrscheinlich. Die stehen in harter Konkurrenz zu Nvidia und sowohl wenn man sich Jensens Auftreten als auch den Xeon-Einsatz in früheren Nvidia-Rigs anguckt, dann ist das eine beidseitige Einstellung. Aber Intel war schon mal offen genug, Prozessoren mit AMD-Grafikeinheit zu verkaufen und Gelsinger hat zumindest die Frage "Intel Prozessor mit Nvidia-IGP?" zumindest öffentlich mit "That would be great!" beantwortet. Bei einem Konsolenprojekt hätten sie auch gute Gründe, aufgeschlossen sein – seit der Xbox hat Intel da kein Geld mehr verdient und hinreichend gute Grafikeinheiten können sie vorerst nicht anbieten. (Alchemist kann zwar die nötige Leistung für heutige Generationen erreichen, braucht dafür aber überproportional große Chips. Battlemage müsste da einiges an Rückstand abbauen, um in diesem kostenopimierten Markt bestehen zu können.) Nvidia als Türöffner käme also gerade recht und es ist auch im Interesse Intels, wenn sich Nvidia an x86-CPUs bindet, die sie nicht selber herstellen können. Umgekehrt wäre ein weiteres Erstarken von Grace-basierten Designs ein Rückschlag von Intel. Die haben schon Apple an ARM verloren.

PCGH_Sven

PCGH-Autor

Ob du's glaubst oder nicht ... der Typ heißt wirklich so."Alan Weckel": Gib's zu, @PCGH_Sven, der Name steht doch nie im Leben so in der Quelle, den musst du dir ausgedacht haben.

Frank-Langweiler

Software-Overclocker(in)

Ich glaube das nicht! Durch die Kontrolle über die Kamera sind die Ansprüche beim Gaming um ein Vielfaches höher. Bis Gesichter lebendig wirken muss es noch sehr lange dauern, länger als im Film mit der festen Perspektive. Da reichen ja auch Kulissen, während unsere Fassaden Substanz brauchen.ja stimmt ja,Filme verwenden ja schon Raytracing.Man merkt es nur nicht mehr,weil man sich ja länger schon dran gewöhnt hat.Bei Filmen tut sich bei der Bildqulität in letzter Zeit nichts mehr.Bei Videospielen kann das auch so passieren wie bei den Filmen ja auch.Ist nur ne Frage der Zeit.

4thVariety

BIOS-Overclocker(in)

Nvidia wird Intel nur unter einer Bedingung ihre GPU Technologie für APUs lizenzieren und das ist wenn Intel im Gegenzug x86 endlich an Nvidia lizenziert.Und düstere Schatten kamen von AMD?

Nvidia als Türöffner käme also gerade recht und es ist auch im Interesse Intels, wenn sich Nvidia an x86-CPUs bindet, die sie nicht selber herstellen können. Umgekehrt wäre ein weiteres Erstarken von Grace-basierten Designs ein Rückschlag von Intel. Die haben schon Apple an ARM verloren.

Für den Fall dass Microsoft ein Pendant zu Rosetta in eine ARM-Version von Windows einbaut, würde es für Intel auch düster aussehen. Was bedeuten denn selbst 50% Overhead bei einer schlechten Version von Rosetta? Anstatt 30% Auslastung im Gaming hat die CPU 45% Auslastung? Kein Problem, oder?

Daher denke ich, Intel ist auf sich alleine gestellt. Es gilt Rückstand bei der Fertigung aufzuholen und einzusehen, dass Apple recht hatte, als sie Intel verlassen haben, um selbst mit einer CPU-GPU-NPU Fusion anzutreten. Das war doch auch bestimmt so ein Ding, bei dem Apple gesagt hat, wir wollen sowas und wenn ihr das nicht liefern könnt, machen wir es selbst.

Quake2008

BIOS-Overclocker(in)

Ich hatte dazu was gelesen, und Apple wollte einen Modularen Chip, der mit verschiedenen CPU´s erweitert werden kann. Energie Effizients und Erweitbarkeit waren prio.Nvidia wird Intel nur unter einer Bedingung ihre GPU Technologie für APUs lizenzieren und das ist wenn Intel im Gegenzug x86 endlich an Nvidia lizenziert.

Für den Fall dass Microsoft ein Pendant zu Rosetta in eine ARM-Version von Windows einbaut, würde es für Intel auch düster aussehen. Was bedeuten denn selbst 50% Overhead bei einer schlechten Version von Rosetta? Anstatt 30% Auslastung im Gaming hat die CPU 45% Auslastung? Kein Problem, oder?

Daher denke ich, Intel ist auf sich alleine gestellt. Es gilt Rückstand bei der Fertigung aufzuholen und einzusehen, dass Apple recht hatte, als sie Intel verlassen haben, um selbst mit einer CPU-GPU-NPU Fusion anzutreten. Das war doch auch bestimmt so ein Ding, bei dem Apple gesagt hat, wir wollen sowas und wenn ihr das nicht liefern könnt, machen wir es selbst.

4thVariety

BIOS-Overclocker(in)

Ist doch Modular, ein CPU Teil, ein GPU Teil, ein NPU teil, verschiedene Modelle skalieren verschiedene Aspekte unterschiedlich und man kann zwei Stück "zusammenkleben" für die Ultra Version.Ich hatte dazu was gelesen, und Apple wollte einen Modularen Chip, der mit verschiedenen CPU´s erweitert werden kann. Energie Effizients und Erweitbarkeit waren prio.

Effizienz waren die Zeichen auf TSMC gestanden. Besserer Prozess, bessere Effizienz, so einfach ist das. Mit ARM hat das noch nicht einmal so wahnsinnig viel zu tun.

Nvidia wird Intel nur unter einer Bedingung ihre GPU Technologie für APUs lizenzieren und das ist wenn Intel im Gegenzug x86 endlich an Nvidia lizenziert.

Nicht "lizensieren". Sondern fertige Chips verkaufen. Das macht Nvidia für gewöhnlich gerne (zu entsprechenden Preisen) und Intel ist sowieso voll auf "Tile"-Kurs mit dem expliziten Ziel eines Baukastensystems.

Ich hatte dazu was gelesen, und Apple wollte einen Modularen Chip, der mit verschiedenen CPU´s erweitert werden kann. Energie Effizients und Erweitbarkeit waren prio.

Apples aktuelle CPU-Palette ist weitaus unflexibler und deutlich schlechter erweiterbar als alles, was sie mit Intel hatten. Aber sie nutzen seit dem Wechsel spürbar fortschrittlichere Fertigungstechniken und teils deutlich größere, im Gegenzug niedriger taktende Chips sowie schnelle, sparsame Speichersysteme die eben gerade keine Rücksicht mehr auf gesockelte/modulare Plattformen nehmen. Das alles gibt Apple einen erheblichen Effizienzvorteil, gerade gegenüber "++++"-Intel.

4thVariety

BIOS-Overclocker(in)

Apples aktuelle CPU-Palette ist weitaus unflexibler und deutlich schlechter erweiterbar als alles, was sie mit Intel hatten. Aber sie nutzen seit dem Wechsel spürbar fortschrittlichere Fertigungstechniken und teils deutlich größere, im Gegenzug niedriger taktende Chips sowie schnelle, sparsame Speichersysteme die eben gerade keine Rücksicht mehr auf gesockelte/modulare Plattformen nehmen. Das alles gibt Apple einen erheblichen Effizienzvorteil, gerade gegenüber "++++"-Intel.

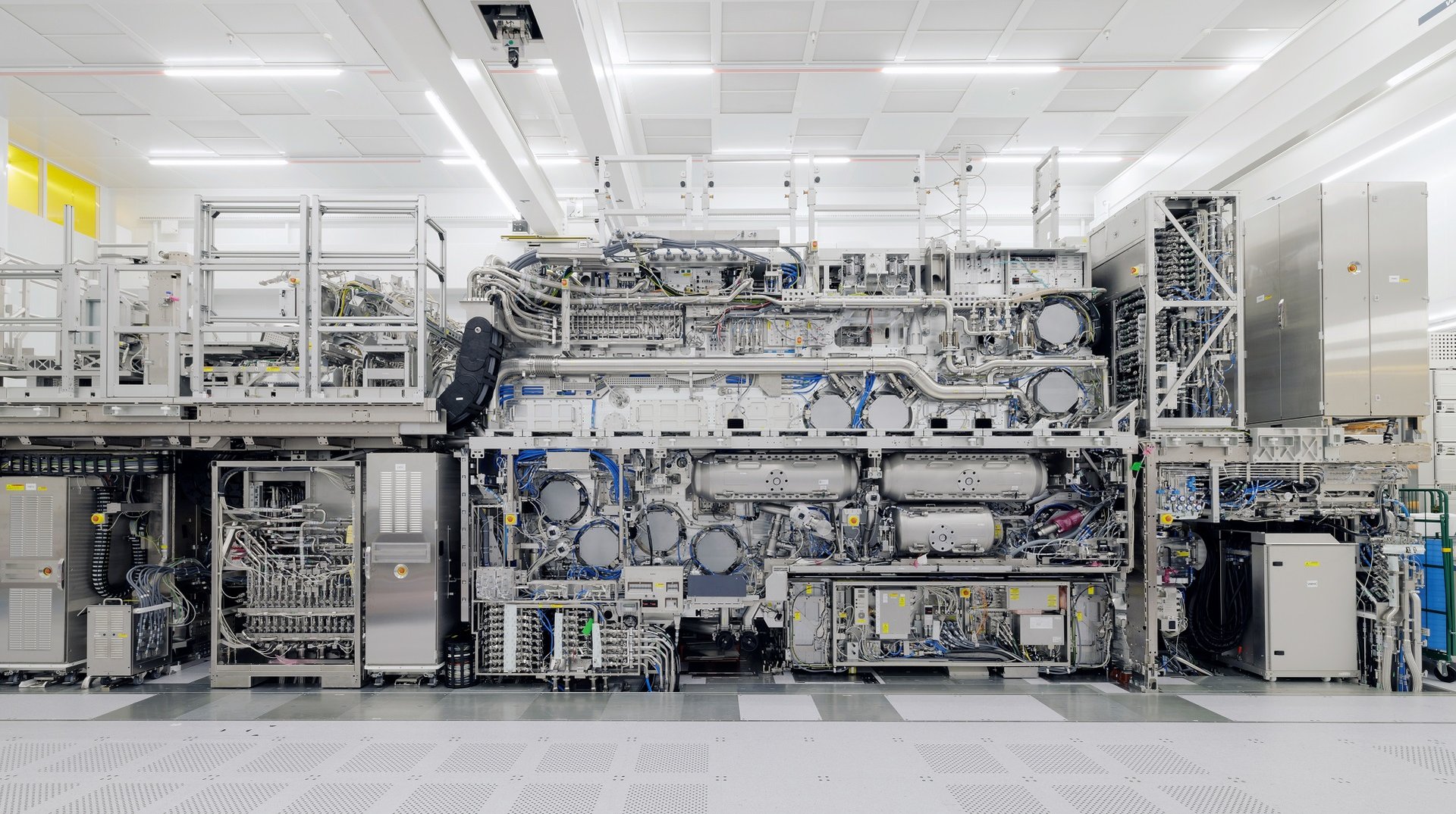

ASML hat im Januar die Auslieferung ihrer ersten High-NA EUV Maschine gefeiert und die ist an Intel gegangen, von daher könnte sich das mit dem Fertigungsnachteil von Intel auch bald wieder ändern, denn TSMC will nicht so schnell auf den Zug aufspringen und noch etwas EUV ausreizen, ++++ und so.

5 things you should know about High NA in EUV

Bringing you the what, why and how behind the latest extreme ultraviolet (EUV) lithography systems

Intel and ASML Strengthen their Collaboration to Drive High-NA into...

Intel makes its first purchase order for ASML’s TWINSCAN EXE:5200 system, marking the next step on the path to EUV 0.55 NA (High-NA) introduction.

Modularität ist imo etwas das unter dem Heatspreader stattfindet, nicht darüber hinaus. Ich denke da wird Intel nicht umhin kommen spezialisierte Schaltungen für CPU, GPU und KI Tasks aus einem "Ding" zu haben das in den Sockel gepackt oder ins Laptop gelötet wird.

Zuletzt bearbeitet:

An High-NA muss Intel sich auch erstmal rantasten. Der Einsatz ist derzeit lose mit dem Nachfolgeprozess zu 18A angedacht, also erst im nächsten Node nach Panther Lake. Der wiederum ist aktuell auf dem Stand, den Comet Lake schon 2021 hatte. Wir reden hier als schätzungsweise von Technologie, die 2028 startet. Wenn Intel endlich mit der versprochenen Beschleunigung ernst macht möglicherweise 2027. Aber so lange dürften Microsoft und Sony nur noch knapp warten wollen und für eine in extrem großen Stückzahlen gefertige Konsole, bei der teildefekte Chips auch schlecht als "kleineres" Modell verkauft werden, nimmt man eher ungern einen brandneuen Prozess.

In meinem Post ging es allerdings nur darum, warum Apple von Intel weg ist. Heutige Intel-CPUs würden sie vielleicht als ausreichend empfinden und den großen Sprung nicht wagen, aber zum Zeitpunkt der Trennung stand Intel schlechter da und hatte überwiegend Versprechen in der Pipeline. Das zu überbieten schien Apple, offensichtlich zu Recht, leicht möglich zu sein.

In meinem Post ging es allerdings nur darum, warum Apple von Intel weg ist. Heutige Intel-CPUs würden sie vielleicht als ausreichend empfinden und den großen Sprung nicht wagen, aber zum Zeitpunkt der Trennung stand Intel schlechter da und hatte überwiegend Versprechen in der Pipeline. Das zu überbieten schien Apple, offensichtlich zu Recht, leicht möglich zu sein.

Naja, ich denke das liegt eher am allgemein niedrigereren Preis und dem höheren Vertrauen in die Langlebigkeit der Chips. Die letzten Konsolen hatten auch zumindest auf GPU-Seite nie einen Vollausbau.Aber so lange dürften Microsoft und Sony nur noch knapp warten wollen und für eine in extrem großen Stückzahlen gefertige Konsole, bei der teildefekte Chips auch schlecht als "kleineres" Modell verkauft werden, nimmt man eher ungern einen brandneuen Prozess.

Vor allem ist man auch wieder unabhängig und Apples Kunden und Zulieferer machen das auch mit. Apple hat auch den Vorteil, dass man nur Chips für ein vergleichsweise schmales Band an Anwendungszenarios braucht. Ich kann aber nur hoffen, dass sich vielleicht ein paar andere Hersteller von Rosetta inspirieren lassen, das ja doch recht eindrucksvoll gezeigt hat, dass die x86-Herrschaft vielleicht doch nicht so absolut ist, wie man vielleicht dachte. Die ist mir ja doch schon auch ein Dorn im Auge.In meinem Post ging es allerdings nur darum, warum Apple von Intel weg ist. Heutige Intel-CPUs würden sie vielleicht als ausreichend empfinden und den großen Sprung nicht wagen, aber zum Zeitpunkt der Trennung stand Intel schlechter da und hatte überwiegend Versprechen in der Pipeline. Das zu überbieten schien Apple, offensichtlich zu Recht, leicht möglich zu sein.

Scheinbar wird er entweder on- oder offline transkompiliert, das ist, zumindest wenn es erledigt ist, noch mal deutlich schneller als eine Emulation.Ja stimmt,mit der methode wird eine x85 dann emuliert,so das diese Programme auch da dann laufen,nicht wahr?

Ähnliche Themen

- Antworten

- 17

- Aufrufe

- 1K

- Antworten

- 4

- Aufrufe

- 575

- Antworten

- 32

- Aufrufe

- 2K

- Antworten

- 29

- Aufrufe

- 2K