Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

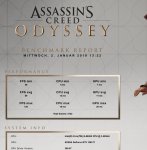

Assassin's Creed Odyssey Benchmark

- Ersteller Gurdi

- Erstellt am

HunterChief

Freizeitschrauber(in)

Firestrike sollte inzwischen auch schon auf jeder halbwegs potenten Graka dauerhaft im CPU-Limit laufen. Dafür gibts ja die Extreme und Ultra-Varianten. Genau aus dem Grund.

Also auf meinem System verhält es sich andersrum ... Timespy erzeugt wesentlich weniger Auslastung auf der GPU, beim Firestrike wird die GPU wesentlich wärmer, und die verbratene GPU-Chip-Power ist viel höher.

Gruß

HisN

Kokü-Junkie (m/w)

96% ist das Maximum, bzw. ab 95% kann man sich am Anfang des CPU-Limits wähnen.

Übrigens kein Unterschied zwischen Turing und Pascal. Ist bei beiden in etwa das gleiche.

WOBEI ... ich letztens auch einen mit 5,2Ghz 8700K hatte, der selbst bei 96% Anzeige der Graka im AC:OD-Benchmark FPS durch runtertakten der CPU verloren hat.

Übrigens kein Unterschied zwischen Turing und Pascal. Ist bei beiden in etwa das gleiche.

WOBEI ... ich letztens auch einen mit 5,2Ghz 8700K hatte, der selbst bei 96% Anzeige der Graka im AC:OD-Benchmark FPS durch runtertakten der CPU verloren hat.

Ich hab gestern auch mal ein bisschen getestet. Für einen reinen Quadcore(!) imo nicht soo übel. Der Wechsel vom neuerdings per Overlay als schlecht abgestempelten Treiber zur neusten Version ändert nicht wirklich was (min FPS sind sogar minimalst schlechter, dürfte aber eher an der Wiederholgenauigkeit des Benchmark liegen).

Anhang anzeigen benchmark_reports.zip

Anhang anzeigen benchmark_reports.zip

Gurdi

Kokü-Junkie (m/w)

96% ist das Maximum, bzw. ab 95% kann man sich am Anfang des CPU-Limits wähnen.

Übrigens kein Unterschied zwischen Turing und Pascal. Ist bei beiden in etwa das gleiche.

WOBEI ... ich letztens auch einen mit 5,2Ghz 8700K hatte, der selbst bei 96% Anzeige der Graka im AC:OD-Benchmark FPS durch runtertakten der CPU verloren hat.

Das Spiel bildet einen ganz seltsamen Overhead, ich kann mir aktuell nicht so recht erklären was das verursacht. Die Radeons sind auf jeden Fall deutlich stärker betroffen.

VikingGe

Software-Overclocker(in)

Die Engine funktioniert grundlegend anders als die der meisten anderen D3D11-Spiele. Ich bin mir ziemlich sicher, dass die eigentlich auf Low Level-APIs ausgelegt ist und D3D11 nachträglich irgendwie angeflanscht wurde, ohne dass man dabei großartig Rücksicht auf Performance genommen hat. Sowohl die Art und Weise, wie Multithreading fürs Rendering eingesetzt wird, als auch die etwas eigenwillige D3D11-Nutzung sprechen dafür.

Generell wird mit GPU-Culling gearbeitet, d.h. ein paar Compute Shader generieren Parameter für Draws (in erster Linie Vertex-Anzahl und -Offset) und filtern dabei unsichtbare Objekte heraus. Später wird das ganze dann mit indirekten Draw Calls gerendert. Das blöde: Die CPU weiß nicht, wie viele Objekte sichtbar sein werden, Dx11 bietet aber keine Möglichkeit, diese Information aus dem Grafikspeicher zu lesen. Also geht das Spiel auf Nummer Sicher und schickt teilweise über 100k Draw Calls pro Frame an die GPU:

Von den ganzen Draw Calls rendern die meisten aber absolut gar nichts. Also wirklich nichts. Schwer zu sagen, wie viele es genau sind, aber schätzungsweise 80% der Draw Calls haben einen Vertex Count von 0, wie im nächsten Screenshot auf der linken Seite zu sehen:

Das belastet nicht nur die CPU, sondern auch den Befehlsprozessor der GPU. Wenn der es nicht schafft, die Rechenwerke mit Arbeit zu füttern, weil fast keiner der Befehle irgendetwas rendert, langweilt sich zumindest zeitweise ein Großteil der GPU, und wenn dann auch noch die CPU es nicht schafft, schnell genug Befehle nachzuschieben, kommt es zu diesem merkwürdigen Verhalten, das ihr da beobachtet habt, wo das Heruntertakten der CPU trotz scheinbarer GPU-Limitierung zu Leistungseinbußen führt.

Für die CPU ist das aber auch problematisch. Die Engine ist zwar gewissermaßen schlau und vermeidet Zustandswechsel zwischen Draw Calls, also z.B. das Auswechseln von Texturen etc. (da kommt bei Dx11 der ganze CPU-Overhead her, von dem immer alle reden). Stattdessen erstellt das Spiel ein paar sehr große (8192x4096) Texturen, in denen ganz viele kleinere Texturen dicht gepackt sind, das sieht dann so aus:

Dennoch kosten 100k leere Draw Calls alleine gut und gerne 8ms CPU-Zeit auf meinem System, d.h. in so einer Situation sind schonmal gar nicht mehr als ~125 FPS möglich. Da im Spiel wie gesagt die meisten Draws nichts rendern, verschwendet das Spiel all diese Zeit für - genau - absolut gar nichts. Ubisoft müsste sich da dringend etwas einfallen lassen - Origins nutzt die gleiche Technik, bringt es auf maximal 50-60k Draw Calls, läuft deutlich besser und sieht z.T. auch noch besser aus, und rendert im Endeffekt auch nicht weniger Objekte.

TL;DR die Engine ist zwar nicht komplett für den Arsch, aber auf dem PC sicherlich nicht so effizient wie sie sein könnte, wenn Ubisoft sich die Mühe gemacht hätte, einen Dx12- oder, Gott bewahre, Vulkan-Renderer einzubauen, was hier wahrscheinlich gar nicht mal so aufwändig wäre.

Aber eigentlich war das hier ein Benchmark-Thread, also hier mal die paar FPS, die meine RX 480 mit maximaler Grafik (außer Wolken) und 1080p-Auflösung unter Linux hinbekommt (Windows auch nur 10% schneller oder sowas). Spielen tu ich das ganze aber mit 30 FPS-Lock.

Generell wird mit GPU-Culling gearbeitet, d.h. ein paar Compute Shader generieren Parameter für Draws (in erster Linie Vertex-Anzahl und -Offset) und filtern dabei unsichtbare Objekte heraus. Später wird das ganze dann mit indirekten Draw Calls gerendert. Das blöde: Die CPU weiß nicht, wie viele Objekte sichtbar sein werden, Dx11 bietet aber keine Möglichkeit, diese Information aus dem Grafikspeicher zu lesen. Also geht das Spiel auf Nummer Sicher und schickt teilweise über 100k Draw Calls pro Frame an die GPU:

Von den ganzen Draw Calls rendern die meisten aber absolut gar nichts. Also wirklich nichts. Schwer zu sagen, wie viele es genau sind, aber schätzungsweise 80% der Draw Calls haben einen Vertex Count von 0, wie im nächsten Screenshot auf der linken Seite zu sehen:

Das belastet nicht nur die CPU, sondern auch den Befehlsprozessor der GPU. Wenn der es nicht schafft, die Rechenwerke mit Arbeit zu füttern, weil fast keiner der Befehle irgendetwas rendert, langweilt sich zumindest zeitweise ein Großteil der GPU, und wenn dann auch noch die CPU es nicht schafft, schnell genug Befehle nachzuschieben, kommt es zu diesem merkwürdigen Verhalten, das ihr da beobachtet habt, wo das Heruntertakten der CPU trotz scheinbarer GPU-Limitierung zu Leistungseinbußen führt.

Für die CPU ist das aber auch problematisch. Die Engine ist zwar gewissermaßen schlau und vermeidet Zustandswechsel zwischen Draw Calls, also z.B. das Auswechseln von Texturen etc. (da kommt bei Dx11 der ganze CPU-Overhead her, von dem immer alle reden). Stattdessen erstellt das Spiel ein paar sehr große (8192x4096) Texturen, in denen ganz viele kleinere Texturen dicht gepackt sind, das sieht dann so aus:

Dennoch kosten 100k leere Draw Calls alleine gut und gerne 8ms CPU-Zeit auf meinem System, d.h. in so einer Situation sind schonmal gar nicht mehr als ~125 FPS möglich. Da im Spiel wie gesagt die meisten Draws nichts rendern, verschwendet das Spiel all diese Zeit für - genau - absolut gar nichts. Ubisoft müsste sich da dringend etwas einfallen lassen - Origins nutzt die gleiche Technik, bringt es auf maximal 50-60k Draw Calls, läuft deutlich besser und sieht z.T. auch noch besser aus, und rendert im Endeffekt auch nicht weniger Objekte.

TL;DR die Engine ist zwar nicht komplett für den Arsch, aber auf dem PC sicherlich nicht so effizient wie sie sein könnte, wenn Ubisoft sich die Mühe gemacht hätte, einen Dx12- oder, Gott bewahre, Vulkan-Renderer einzubauen, was hier wahrscheinlich gar nicht mal so aufwändig wäre.

Aber eigentlich war das hier ein Benchmark-Thread, also hier mal die paar FPS, die meine RX 480 mit maximaler Grafik (außer Wolken) und 1080p-Auflösung unter Linux hinbekommt (Windows auch nur 10% schneller oder sowas). Spielen tu ich das ganze aber mit 30 FPS-Lock.

JackTheHero

BIOS-Overclocker(in)

Da sieht es in WQHD bei mir so aus:

Musst AA auf full stellen, sonst wird nicht mal mit voller Auflösung gerendert. Digital Foundry oder so hat das mal erklärt in einem frühen Video.

Bei mir sieht es bei einem Fight in Athen so aus. ^^ Ich hab nicht damit gerechnet das zu überleben. ^^

Eingebundener Inhalt

Youtube

An dieser Stelle findest du externe Inhalte von Youtube. Zum Schutz deiner persönlichen Daten werden externe Einbindungen erst angezeigt, wenn du dies durch Klick auf "Alle externen Inhalte laden" bestätigst:

Ich bin damit einverstanden, dass mir externe Inhalte angezeigt werden. Damit werden personenbezogene Daten an Drittplattformen übermittelt.Für mehr Informationen besuche die Datenschutz-Seite.

Ich hab aber auch das Gefühl, dass das SPiel selber irgendwann überlastet ist. Man kann noch tote Gegner auf Straßen liegend finden, die ich vor 50 Stunden oder so mal erledigt hab. Wenn die alle auch noch gerendert werden müssen..

Zuletzt bearbeitet:

ChrisMK72

PCGH-Community-Veteran(in)

ChrisMK72

PCGH-Community-Veteran(in)

Aber das sieht doch schlecht aus so(allein schon depth of field ! Gruselig ! Und das hohe AA find' ich auch Mist. Matschbild ! Sieht einfach schlecht aus. Bei Schatten gefallen mir auch die niedrigen am besten. Is sicher auch Geschmackssache, aber hab da lange rumgetestet.) und ist fern der Spielerealität. So würde ich nicht zocken wollen. Was soll das bringen ? Da könnt ich ja gleich in 8k, oder 720p testen. Wenn andere so spielen mögen, mag ich das noch lange nicht !

Ich hab auch ewig dran rumgestellt, um meine Lieblingseinstellungen hin zu kriegen. Hab keine Lust da dran rumzufuschen. Nachher bekomm ich das nicht wieder so hin.

Ich zock auch sehr ungern, mit niedrigeren fps. Das ist für mich nicht mehr schön. Auch wegen der Reaktionszeiten. Das fühlt sich nicht mehr fluffig an, beim zocken. Also warum sollte man sowas testen ?

Ich würde ja auch nix testen, wo ich mit 30 fps rumkrieche, bloß, weil das "Ultra in 4k" ist. Einfach weil's Quatsch ist. Bringt doch nix.

Ganz ehrlich: Mit durchschnittlich 60 fps wär ich nie zufrieden. Das heißt ja auch oft 40 ? , denk' ich mal. Da fühlt sich ja jede Bewegung, wie mit angezogener Handbremse an !

Da könnt' ich ja gleich Konsole zocken. Naja ... fast zumindest(etwas schlimmer ist das doch noch ! ). Ich hoffe du verstehst, was ich meine.

). Ich hoffe du verstehst, was ich meine.

Ich hoffe für euch, dass ihr nicht wirklich mit 20-40 fps zockt(wie im ersten Bild des Threads, mit min. 25 und Durchschnitt 47 fps).

Und für einen reinen Belastungstest(synthetisch), für CPU und GPU gibt es ja sicher bessere Programme, um die auszulasten.

Oder sollte das der Sinn dieses Threads sein und ich hab's nur nicht kapiert ?

Ich dachte hier nutzt jeder echte Spieloptionen/Einstellungen, wie man wirklich zockt.

-----------------

edit:

Ok Gurdi, mein Freund ...

Weil Du's bist, hab ich mir die Mühe gemacht, alle Optionen abzufotographieren, damit nix verloren geht und mache nun neue Tests, damit das hier besser reinpasst. Es ist ja dein Thread und ich passe mich an.

Erst mal hab ich gar keine "Ultra" Einstellungen gefunden. Die gibt es nicht.

Ich hab mich dann für "Extrem Hoch" entschieden und wie du gesagt hast, die Wolken eine EInstellung runter auf "sehr hoch", anstatt extrem hoch(ultra gibt's da auch nicht) gestellt und den Rest so gelassen. Wir wollen ja genau bleiben, zwecks Vergleichbarkeit.

Hier meine ersten Ergebnisse:

Ich hab auch ewig dran rumgestellt, um meine Lieblingseinstellungen hin zu kriegen. Hab keine Lust da dran rumzufuschen. Nachher bekomm ich das nicht wieder so hin.

Ich zock auch sehr ungern, mit niedrigeren fps. Das ist für mich nicht mehr schön. Auch wegen der Reaktionszeiten. Das fühlt sich nicht mehr fluffig an, beim zocken. Also warum sollte man sowas testen ?

Ich würde ja auch nix testen, wo ich mit 30 fps rumkrieche, bloß, weil das "Ultra in 4k" ist. Einfach weil's Quatsch ist. Bringt doch nix.

Ganz ehrlich: Mit durchschnittlich 60 fps wär ich nie zufrieden. Das heißt ja auch oft 40 ? , denk' ich mal. Da fühlt sich ja jede Bewegung, wie mit angezogener Handbremse an !

Da könnt' ich ja gleich Konsole zocken. Naja ... fast zumindest(etwas schlimmer ist das doch noch !

). Ich hoffe du verstehst, was ich meine.

). Ich hoffe du verstehst, was ich meine.Ich hoffe für euch, dass ihr nicht wirklich mit 20-40 fps zockt(wie im ersten Bild des Threads, mit min. 25 und Durchschnitt 47 fps).

Und für einen reinen Belastungstest(synthetisch), für CPU und GPU gibt es ja sicher bessere Programme, um die auszulasten.

Oder sollte das der Sinn dieses Threads sein und ich hab's nur nicht kapiert ?

Ich dachte hier nutzt jeder echte Spieloptionen/Einstellungen, wie man wirklich zockt.

-----------------

edit:

Ok Gurdi, mein Freund ...

Weil Du's bist, hab ich mir die Mühe gemacht, alle Optionen abzufotographieren, damit nix verloren geht und mache nun neue Tests, damit das hier besser reinpasst. Es ist ja dein Thread und ich passe mich an.

Erst mal hab ich gar keine "Ultra" Einstellungen gefunden. Die gibt es nicht.

Ich hab mich dann für "Extrem Hoch" entschieden und wie du gesagt hast, die Wolken eine EInstellung runter auf "sehr hoch", anstatt extrem hoch(ultra gibt's da auch nicht) gestellt und den Rest so gelassen. Wir wollen ja genau bleiben, zwecks Vergleichbarkeit.

Hier meine ersten Ergebnisse:

Anhänge

Zuletzt bearbeitet:

I

IICARUS

Guest

Dann könnte auch kein Vergleich mit diesem Spiel aufgestellt werden, denn wenn jeder was anderes einstellt dann fällt das Ergebnis auch wieder ganz anders aus. Natürlich kann das ganze anderweitig getestet werden, aber hier geht es um die Last was dieses Spiel erzeugt und wie jedes System damit auskommt.Ich dachte hier nutzt jeder echte Spieloptionen/Einstellungen, wie man wirklich zockt.

Habe das Spiel heute auch im Angebot kaufen können.

Werde mir das Spiel mal ansehen und dann auch versuchen hier meine Ergebnisse einzustellen.

Momentan bin ich noch am herunterladen.

ChrisMK72

PCGH-Community-Veteran(in)

Jo .... hatte es oben schon editiert. Also Grafik Extrem Hoch angepasst auf Wolken sehr hoch. (Ultra gibt's nicht bei mir).

Hier nun noch die Einstellungen mit Grafik Extrem hoch mit Wolken auch auf Extrem hoch(ich finde immer noch kein ultra, leider. Evtl. heißt das auch in der englischen Version Ultra und in der deutschen extrem hoch ?).

P.S.: So spielt doch kein Mensch, oder ? Eine einzige Ruckelorgie ... lag lag lag.

Nun werd' ich alles wieder "normal" einstellen. Hoffentlich klappt's !

edit: Hatte vergessen, dass im Hintergrund während der Benchmarks bei mir noch Fraps und Afterburner lief.

Evtl. kam auch der ein, oder andere lagspike dadurch.

Hier nun noch die Einstellungen mit Grafik Extrem hoch mit Wolken auch auf Extrem hoch(ich finde immer noch kein ultra, leider. Evtl. heißt das auch in der englischen Version Ultra und in der deutschen extrem hoch ?).

P.S.: So spielt doch kein Mensch, oder ? Eine einzige Ruckelorgie ... lag lag lag.

Nun werd' ich alles wieder "normal" einstellen. Hoffentlich klappt's !

edit: Hatte vergessen, dass im Hintergrund während der Benchmarks bei mir noch Fraps und Afterburner lief.

Evtl. kam auch der ein, oder andere lagspike dadurch.

Anhänge

Zuletzt bearbeitet:

Ähnliche Themen

- Antworten

- 0

- Aufrufe

- 14K

- Antworten

- 14

- Aufrufe

- 2K

- Antworten

- 19

- Aufrufe

- 4K

- Antworten

- 19

- Aufrufe

- 3K

N

- Antworten

- 9

- Aufrufe

- 9K