Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

News AMD: RX 7800 und 7700 könnten auf der Gamescom vorgestellt werden [Gerücht]

- Ersteller PCGH-Redaktion

- Erstellt am

seahawk

Lötkolbengott/-göttin

Natürlich für maximale Qualität wird man mehr brauchen, als die NV-Karten unterhalb der 4090 haben.bei Ultra oder EPIC

... kann ich mir net vorstellen, ... für die Zukunft

Konsolenstyle ist vllt. High

RX480

Lötkolbengott/-göttin

Das würde vllt. jetzt Mancher(x) anders sehen, aber für Rastergamer sicherlich ausreichend bis 2028, wenn mit der PS6 neue

Dingens im Mittelpunkt stehen.

(x) meinte Blautempel mit dem Stand der Softwareinfrastruktur

Denke auch, das erstmal bei den 144Hz- 4k-Monis mehr preiswerte Auswahl her muss, ... falls doch mal FG bei RDNA3 einzieht.

(sollten net mit 8k-OLED-TV´s dann auch geviertelte 4k-Paneels für Monis machbar sein, ... möglichst bis Weihnachten)

Dingens im Mittelpunkt stehen.

(x) meinte Blautempel mit dem Stand der Softwareinfrastruktur

Denke auch, das erstmal bei den 144Hz- 4k-Monis mehr preiswerte Auswahl her muss, ... falls doch mal FG bei RDNA3 einzieht.

(sollten net mit 8k-OLED-TV´s dann auch geviertelte 4k-Paneels für Monis machbar sein, ... möglichst bis Weihnachten)

Zuletzt bearbeitet:

L

Lohnkrake

Guest

Sollte die Bandbreite zeitnah an Relevanz dazugewinnen, wäre die 4080 die vllt. schnellere Karte (vor allem in RT), dafür würde die 7900 XTX "besser altern".

Wäre für 1440p und Max Texturen durchaus relevant.

Wäre für 1440p und Max Texturen durchaus relevant.

BigYundol

BIOS-Overclocker(in)

Doof ist aber natürlich das sie nicht mal den 379mm² kleinen, 76SM schweren AD103 der RTX 4080 voll unter Kontrolle haben.

Ich kann mir beim besten Willen nicht vorstellen dass das so AMDs Ziel war.

Die 4080 ist aus meiner Sicht rein vom Chip her der gelungenste der RTX4000-Generation. Verglichen zu dem Chip ist auch die 4090 eine Luftpumpe. Schade dass sie "nur" 16GB hat.

RX480

Lötkolbengott/-göttin

Die 4080 hatte zu keinem Zeitpunkt ne höhere Bandbreite.Sollte die Bandbreite zeitnah an Relevanz dazugewinnen, wäre die 4080 die vllt. schnellere Karte (vor allem in RT), dafür würde die 7900 XTX "besser altern".

eigentlich ist die 256bit-4080 sogar hinsichtlich Bandbreite <der 320bit-7900xt@800GB/s

(Was genau die Bandbreite "vor allem in RT" steigern soll, erschliesst sich mir net.)

Das Ada momentan in der RT-Architektur nen Schritt weiter geht, lässt man sich auch gut bezahlen.

Wers unbedingt Jetzt braucht, muss dann halt löhnen.

Bis Pathtracing mal ne dominante Rolle spielt wirds bestimmt noch Jahre dauern.

Zuletzt bearbeitet:

Infi1337

Freizeitschrauber(in)

Schnelligkeit stiegert wahrscheinlich auch die RT Leistung bzw. GDDR6 vs GDDR6X. Das Bandbreitenstats völlig irrelevant sind sollte man nach der Radeon 7 eigenlich gelernt haben.Die 4080 hatte zu keinem Zeitpunkt ne höhere Bandbreite.

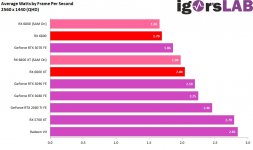

Anhang anzeigen 1431580

eigentlich ist die 256bit-4080 sogar hinsichtlich Bandbreite <der 320bit-7900xt@800GB/s

(Was genau die Bandbreite "vor allem in RT" steigern soll, erschliesst sich mir net.)

RX480

Lötkolbengott/-göttin

Die Radeon VII hatte nur Pech, das es keine Games+Reviews mit voller 16GB-Vram-Ausnutzung gab/geben durfte.

(weiss net obs bei aktuellen Games anders ausschaut zw. 2080 und R7)

btw.

RT ist halt RT, da helfen nur mooore RT-Cores

(solange man net im Vram-Bottleneck ist)

(weiss net obs bei aktuellen Games anders ausschaut zw. 2080 und R7)

btw.

RT ist halt RT, da helfen nur mooore RT-Cores

(solange man net im Vram-Bottleneck ist)

Die RTX 4090 wird relativ immer besser, je mehr Last man draufschmeißt. Wenn sie also nicht gut aussieht, limitiert die Infrastruktur.Die 4080 ist aus meiner Sicht rein vom Chip her der gelungenste der RTX4000-Generation. Verglichen zu dem Chip ist auch die 4090 eine Luftpumpe. Schade dass sie "nur" 16GB hat.

Vega altert in etwa so gut wie Pascal. Hilfreich ist vor allem der Speicher. Allerdings hält sich Turing dank der modernen Architektur und Features wesentlich besser - etwa in Gestalt der RTX 2080 Ti. Die 2080 und alle anderen 6- und 8-GiB-Modelle kränkeln zunehmend an ihrer Speichermenge.Die Radeon VII hatte nur Pech, das es keine Games+Reviews mit voller 16GB-Vram-Ausnutzung gab/geben durfte.

(weiss net obs bei aktuellen Games anders ausschaut zw. 2080 und R7)

MfG

Raff

RX480

Lötkolbengott/-göttin

Die 2080Ti ist vllt. das rundeste Produkt ever bzgl. Rohleistung zu Vram+Bandbreite.

(selbst wenn man sich beim Launch über die nur 12GB ggü. den 11GB beim Vorgänger geärgert hatte)

Was dann die 3070 als "Vollwertiger Ersatz" sollte , weiss nur der Küchenchef.

(da wären sicher auch 16GB beidseitig für 50€ mehr interessant gewesen, ala 3090)

(selbst wenn man sich beim Launch über die nur 12GB ggü. den 11GB beim Vorgänger geärgert hatte)

Was dann die 3070 als "Vollwertiger Ersatz" sollte , weiss nur der Küchenchef.

(da wären sicher auch 16GB beidseitig für 50€ mehr interessant gewesen, ala 3090)

Zuletzt bearbeitet:

Mit im Vergleich unglaublich wenig Aufwand die selbe Renderleistung erreichen. Und das tut sie außerhalb des RAM-Limits ja auch.Was dann die 3070 als "Vollwertiger Ersatz" sollte , weiss nur der Küchenchef.

Aus Ökonomischer Sicht ein Traum und genau das woran AMD regelmäßig scheitert.

Was übrigens tatsächlich eine gute Überleitung zu Navi32 ist. Im Grunde soll er nämlich genau das zu Navi21 sein was der kleine GA104 zum TU102 war. Selbe Leistung zum, mindestens für den Hersteller, deutlich reduzierten Preis.

Zuletzt bearbeitet:

@RX480 Den hohen Preis hat AMD aber bezahlt. Das Ding ist in 7nm deutlich größer ( 520mm2 zu 392mm2) als die 3070 in 8nm(was ja eigentlich ein getunter 10nm Prozess ist).

Als Kunde hätte ich bei der konkreten Konkurrenz zum selben Preis auch die 6800 genommen. Aber bevor NV nicht schon bei Ada angefangen hatte, gab es sie nicht zum selben Preis.

Das technisch vergleichbare Produkt wäre eigentlich die 3080 gewesen.

Als Kunde hätte ich bei der konkreten Konkurrenz zum selben Preis auch die 6800 genommen. Aber bevor NV nicht schon bei Ada angefangen hatte, gab es sie nicht zum selben Preis.

Das technisch vergleichbare Produkt wäre eigentlich die 3080 gewesen.

RX480

Lötkolbengott/-göttin

Mehr verschiedene Chips konnte sich AMD damals vermutlich net leisten, denke so ca. 400mm² als extra Chip

wäre möglich gewesen.(weiss net wie hoch die Kosten für ne extra Maske+Design gewesen wären)

btw.

Im Nachhinein betrachtet hätte die 6800ref. auch mit UVen vom Kühler her gereicht und man hätte ein langlebiges Produkt

ohne Degenerierung der WLP.

extreme.pcgameshardware.de

Die Ref. war@Launch eigentlich im AMD-Shop immer Donnerstags verfügbar.

extreme.pcgameshardware.de

Die Ref. war@Launch eigentlich im AMD-Shop immer Donnerstags verfügbar.

wäre möglich gewesen.(weiss net wie hoch die Kosten für ne extra Maske+Design gewesen wären)

btw.

Im Nachhinein betrachtet hätte die 6800ref. auch mit UVen vom Kühler her gereicht und man hätte ein langlebiges Produkt

ohne Degenerierung der WLP.

3DMark-Rangliste: Geforce- und Radeon-Grafikkarten im Benchmark - und wie schnell ist Ihre?

Da kann auch einfach der Chip/Boost ein mue besser sein oder/und der Vram spart noch 3-4W. = 3-4W mehr für den Core

Zuletzt bearbeitet:

Es gab und gibt einen zur 3070 vergleichbar großen Chip. Der nennt sich Navi22, hatte aber selbst als KXT am Ende zu wenig Chancen, so dass wir den unbeschnittenen GA104 nie zu Gesicht bekommen haben.Mehr verschiedene Chips konnte sich AMD damals vermutlich net leisten, denke so ca. 400mm² als extra Chip

wäre möglich gewesen.(weiss net wie hoch die Kosten für ne extra Maske+Design gewesen wären)

Aus Kundensicht ein ekelhaftes Upselling bei NV, aus technischer Sicht vorallem Blamagen bei AMD.

RX480

Lötkolbengott/-göttin

Die N22/6700xt/6750 ist vgl. mit der 6800 mir persönlich zu sehr über Sweetspot.(x)

Schau mal im Post über Dir, wo DaHell extra seine 6800 mit ner 6750 vgl. hat.(lnk zur Rangliste/Thread)

(x) falls man nur so ca. 80€ mehr für das nächstgrößere Modell bezahlt und mit einem mue weniger Fps leben kann,

ist UVen der Königsweg, ... schätze mal 10% weniger Fps gegen 30-40% weniger W ist einfach sinnvoller

Leider war die 6800 heute früh nur kurz im Angebot, der Preis war passend mit 449€ incl. Starfield.

(vor 6Uhr hätte man auch noch die Versandkosten gespart, ... wenn schon denn schon, da lohnt es sich,

die erste Tasse Kaffe am PC einzunehmen und mal die Angebote zu checken)

Schau mal im Post über Dir, wo DaHell extra seine 6800 mit ner 6750 vgl. hat.(lnk zur Rangliste/Thread)

(x) falls man nur so ca. 80€ mehr für das nächstgrößere Modell bezahlt und mit einem mue weniger Fps leben kann,

ist UVen der Königsweg, ... schätze mal 10% weniger Fps gegen 30-40% weniger W ist einfach sinnvoller

Leider war die 6800 heute früh nur kurz im Angebot, der Preis war passend mit 449€ incl. Starfield.

(vor 6Uhr hätte man auch noch die Versandkosten gespart, ... wenn schon denn schon, da lohnt es sich,

die erste Tasse Kaffe am PC einzunehmen und mal die Angebote zu checken)

Anhänge

Zuletzt bearbeitet:

JoM79

Trockeneisprofi (m/w)

Was meinst du mit unbeschnitten?Es gab und gibt einen zur 3070 vergleichbar großen Chip. Der nennt sich Navi22, hatte aber selbst als KXT am Ende zu wenig Chancen, so dass wir den unbeschnittenen GA104 nie zu Gesicht bekommen haben.

Die 3070ti hatte doch nen unbeschnitten GA104.

Ähnliche Themen

- Antworten

- 26

- Aufrufe

- 2K

- Antworten

- 12

- Aufrufe

- 961

- Antworten

- 8

- Aufrufe

- 805

- Antworten

- 3

- Aufrufe

- 569