Geometrisch ist das ein riesiger Unterschied hinsichtlich Signalreflektionen. Ein ZIF-PGA-Sockel-Kontakt besteht in der Regel aus einer Y-förmigen Gabel im Sockel in die der Pin vom Package seitlich reingeschoben wird. Abgesehen davon, dass diese Verbindung auch noch horizontal zum PCB aufgebaut ist und somit zweimal ein 90° Knick für weitere Reflektionen sorgen kann, hat man also zwangsläufig die beiden Spitzen der Gabel und das untere des Pins als Sackgasse. Wie stark sich das auswirkt, kann ich nicht selbst beurteilen, aber es ist zumindest etwas, worüber Ingenieure gerne jammern. Siehe auch Vor- und Nachteile diverser Topologien für RAM. Bei der Einführung von LGA-Sockeln war die bei gleichem Aufwand höhere Kontaktdichte auch nur ein Faktor, unter anderem ging es auch um die Vereinfachung der Kontaktgeometrie. So bildet die Kontatkfeder im Prinzip eine lineare Fortsetzung der Leiterbahn und wenn die Krümmung am Ende perfekt passt, hat man gar kein offenes Ende.

Der zweite Aspekt neben möglicher Störungen ist dann noch elektrische Übergang am Kontakt selbst. So eine Auflagefäche muss überhaupt erst mal mit Kraft an ihr Gegenstück gepresst werden (Intel arbeitet zum Beispiel mit 0,3-0,6 N pro Pin, ergäbe für ein einzelnes 180er GDDR6-Package also rund 10 kg Anpresslast) und aufgrund von Oberflächenunebenheiten ist die Fläche mit tatsächlichem Metall-Metall-Konakt dann immer noch deutlich kleiner als bei einer sauberen Verlötung.

Ich erinnere in dem Zusammenhang an die Schraubzwingen bei den ersten HMC-Vorführungen.

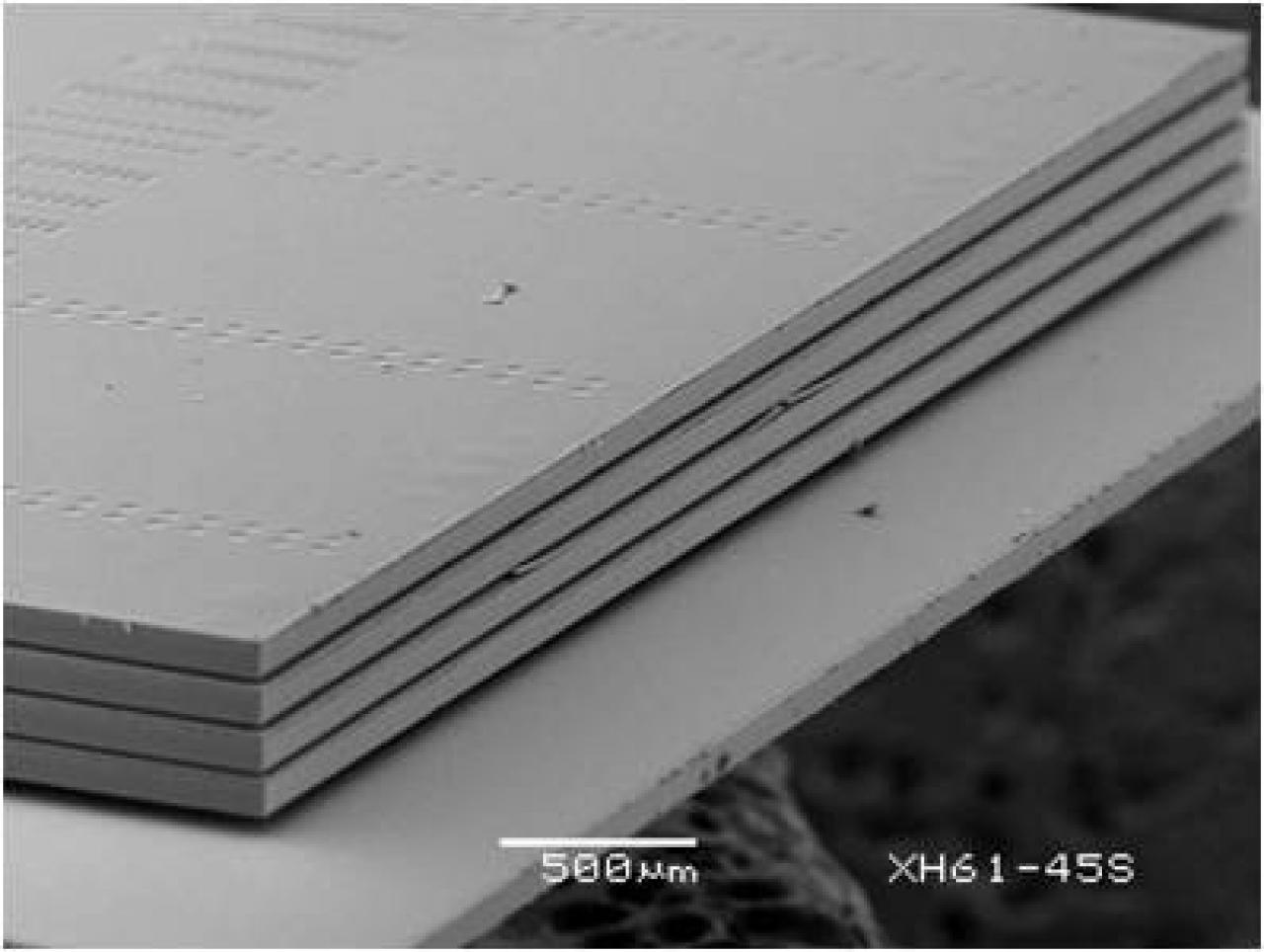

Intel forscht mit Micron an einer neuen Speichertechnik. Ein Sandwich aus hocheffizienten Speicherschichten und neuartigen Controllern und Logiken bringt es in ersten Tests auf 1 Tbit/s Transferrate und verbraucht dabei weniger Energie als DDR3-Pendants.

www.pcgameshardware.de

Allein wegen der nötigen mechanischen Vorrichtungen würde sich also ein deutlich raumgreifenderes Layout ergeben – und HMC war für 10 GT/s seriell vorgesehen, die die Prototypen nicht einmal erreicht haben dürften. 19 GT/s parallel, also mit zusätzlichen Routingkompromissen um die Leiterbahnenlängen gleich zu halten, wäre wesentlich komplizierter. Ich sage bewusst nicht "unmöglich", aber am Ende des Tages muss jeder Aufwand bezahlt werden und während man im High-End-Bereich unverschämte Aufpreise für einen Tick mehr Speicher verlangt, reden wir hier von Chips die im Midrange-Bereich für bestenfalls niedrige zweistellige Summen Endundenpreis pro Exemplar verbaut werden.

Eine Aufrüstlösung darf aber inklusive der initialen Speicherausstattung nicht teurer sein als der zu erwartende Preisverfall beim später geplanten Speicher – wenn in deinem 980-Ti-Beispiel der Kauf neuer und Verkauf alter Chips 150 Euro kosten würde, dann blieben 150 Euro für sämtliche Modularisierungskosten von der Entwicklung über das vergrößerte, deutlich aufwendigere PCB und die komplexen Chip-Packages bis hin zum angepassten, bei gleichen Ansprüchen an Volumen und Leistung ebenfalls problematischem Kühler, jeweils inklusive Marge und Steuern, da ich hier mit Endkundenpreisen rechne. Ansonsten wäre dein Upgrade nicht günstiger, als direkt eine GTX Titan X zu kaufen, die dir den Speicherboost (und mehr GPU-Leistung) am Tag 1 geliefert hätte. Und das war schon ein Beispiel aus dem überteuerten High-End-Bereich und ein glücklicher Zufall, da tatsächlich relativ ähnlicher Speicher in der Vorgängergeneration verwendet wurde. Mit einer 1080 Ti könntest du den alten RAM dagegen wegschmeißen, denn die 980-Ti-Besitzer könnten mit deinem neumodischen Kram gar nichts anfangen. Reparaturen wären ein besseres Argument, aber einerseits sind die für Profis auch heute schon möglich und andererseits hält der überwältigende Teil der Karten so lange, dass die Ablöse durch eine ähnlich starke Neuerscheinung meist schon billiger ist, als überhaupt einen Techniker zu deutschen Stundenlöhnen das eigentliche Problem ermitteln zu lassen.

Danach hat es ein bisschen gedauert bis ich mich wieder rangewagt hab.

Danach hat es ein bisschen gedauert bis ich mich wieder rangewagt hab.

.gif) ) ;-P

) ;-P