Dümmster anzunehmender Fehler:

Der HDMI Eingang vom TV in dem das Kabel steckt ist kein 4k Eingang, sondern nur HDMI 1.2 mit FullHD. Ich sehe bei dir Port 4, bei meinem Sony sind nur Port 2 und 3 4k Ports. Warum? Frag Japan. Macht das Flackern nicht besser, bedeutet nur dass die Bitrate schon fernab der 4k wackelt.

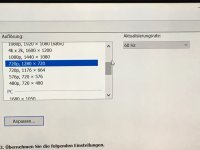

Jetzt sollten wir das Problem los sein, dass Windows den TV als FullHD erkennt. Vielleicht. Vielleicht ist das Kabel immer noch so lange und auf die Entfernung werden nur mit viel gutem Willen FHD ausgehandelt und sogar die knicken ab.

Gleich das nächste Problem. Bei drei 1440p Monitoren die alle auf 165Hz laufen würde ich mal sagen bleiben der 3090 nicht genug Bandbreite für weitere 4k. Denn laut Nvidia Spezifikation kann eine 3090 maximal 8k bei nicht näher spezifizierten Hertz. (

https://www.nvidia.com/de-de/geforce/graphics-cards/30-series/rtx-3090-3090ti/) Danke Nvidia sehr professionell. Wieivle Gigabit and Bild-Daten Nvidia auf die Monitore verteilen kann ist also ein Rätsel. Nachdem die Karte aber HDMI 2.1 unterstützt müssen es

mindestens 48GBit sein, oder ein 8k TV, oder ein 4k120Hz TV.

Aber einer deiner einzelnen 165Hz Monitore alleine frisst schon mindestens 22,44Gigabit. Wenn die alle drei laufen ist die interne leistung der Karte über der eines einzelnen Anschlusses und mindens bei 67,2 Gigabit pro Sekunde an digitalem Datenstrom in dein Anzeigegerät. Aus anderen Threads wissen wir, dass eine Nvidia so bei 100Gbit ihre Grenze hat. Deswegen haben andere Leute mit drei 144Hz 4k TVs auch so ihre lieben Probleme.

Deinen TV voll anzufahren würde bedeuten 4k@120Hz = 48Gigabit die du über das Kabel jagen müsstest. Der DelayCon den du gepostet hast mach 8,16Gbit, wandert also gleich in die Tonne. Ehrlich gesagt würde weder ein Shield noch ein Apple TV4k die 120Hz liefern, die extrahiert man nur über die eingebauten Apps, einer PS5 oder einem PC im gleichen Zimmer, weil dann das Kabel nicht zu lange ist.

Ein HDMi 2.0 Repeater bringt nix in dem SInne, dass du dann von FHD auf 4k kommst, aber ohne 10Bit und HDR und dann ist schon die Frage warum du den TV hast. Deine 165Hz Displays würdest du auch nicht auf 30Hz laufen lassen, warum also einen HDR TV ohne HDR?

HDMI 2.1 Repeater auf Amazon haben so Kleingedrucktes wie das hier

Der HDMI Verstärker 8K unterstützt 8K bei 60 Hz bei einer Kabellänge von insgesamt bis zu 7,92 m; der 8K HDMI-Signalverstärker unterstützt bis zu 10,67 m für 4K bei 60 Hz und bis zu 25 m für HD 1080 bei 60 Hz

viele finden das gerne auf eigene Faust heraus warum der Repeater nicht so geht wie man sich das vorstellt, die Realität ist, dass 4k auf deine Entfernung nicht stattfinden werden.

Apple Fanbois kaufen an der Stelle einen Apple TV 4k, der hat aber kein Kodi, müsste man auf Plex umsteigen. Alle anderen kaufen ein Shield, weil das Shield mit dem SoC im TV zu vergleichen und meinen es würde so träge reagieren, ist als würde man eine 4090 in Cyberpunk gegen eine 970 benchen. Da drückt man den Knopf und es passiert sofort was, nicht nach einer Sekunde wie bei den lahmarschigen SoCs in den TVs.

Investiere also gerne noch Lebenszeit in Höhe der Kosten eines Shield Pro in das Problem und kauf dann ein Shield Pro. Aber nur weil du ein Problem in einem Satz einfach ausdrücken kannst "ich zieh ein Kabel von meiner 3090 zum TV", bedeutet das noch lange nicht, dass das geht, fehlerfrei geht und ohne Probleme geht. Sonst wären wir alle schon auf dem Mars, da muss man ja einfach nur hinfliegen ist man dort. Ein Shield auf dem Kodi läuft und sich die Video-Daten von deinem PC holt ist jedoch genau das, einfach. 24FPS Mode, HDR, alle Schikanen. Weil Dolby Vision 24fps Cinematic Mode auf WIndows zu konfigurieren, da hängt man sich vorher auf bis das den Film richtig darstellt. Dafür ist Windows einfach nicht gemacht.